Chapter 13: 한계와 미래 — Physical AI for Manufacturing

개요

이 책을 통해 촉각 센서에서 VLA 모델까지, 로봇 핸드에서 산업 배치까지의 전체 그림을 그렸습니다. 이 마지막 챕터에서는 131편의 문헌을 기반으로 기존 연구의 공통 한계점 TOP 10을 체계적으로 정리하고, 5개 그룹의 미래 연구 방향, 10개의 제조업 특화 과제, 그리고 우리의 연구 방향 제안을 다룹니다.

이 챕터를 읽고 나면... - 촉각 기반 조작 연구의 공통 한계점 10가지를 열거할 수 있습니다. - 5개 연구 그룹(센싱, 학습, 하드웨어, 데이터, 배치)의 미래 방향을 설명할 수 있습니다. - 연구 시연과 제조 현장의 격차(3-5년)를 이해합니다. - 메커니즘 + 촉각 + 학습 삼각 통합의 연구 방향을 설명할 수 있습니다.

13.1 기존 연구의 공통 한계점 TOP 10

| 순위 | 한계점 | 빈도 | 핵심 이슈 | 관련 챕터 |

|---|---|---|---|---|

| 1 | Sim-to-Real Gap | 20+ | 촉각 sim-to-real이 시각보다 어려움 | Ch9 |

| 2 | Novel Object Generalization | 15+ | 물성(material) 미반영 | Ch7, Ch8 |

| 3 | Sensor Durability | 12+ | 젤 마모, 교정 소실 | Ch2 |

| 4 | Data Scarcity | 12+ | ~10 demos/hr, 촉각 특히 어려움. 단, EgoScale (NVIDIA, 2026) [21]은 인간 데이터의 log-linear 스케일링 법칙을 발견 — R²=0.998로, 20,854시간의 인간 데이터에서 데이터 양 증가 시 예측 가능한 성능 향상을 검증. 데이터 수집의 확장이 곧 성능 향상으로 직결됨을 시사 | Ch3, Ch6 |

| 5 | Hardware Cost/Fragility | 10+ | MTBF 데이터 부재 | Ch4 |

| 6 | Cross-Embodiment Transfer | 10+ | 촉각 전이: UniTacHand 1편뿐. 단, 운동학적/시각적 도메인에서는 2024-2026년 급속한 진전 — EgoMimic (Georgia Tech, 2024) [22]: 1시간 인간 데이터 > 2시간 로봇 데이터 (+34-228%); X-Sim (Cornell, CoRL 2025 Oral) [23]: 로봇 데이터 0건으로 실제 태스크 성공; VidBot (TU Munich, CVPR 2025) [24]: 인터넷 비디오만으로 +20% zero-shot 성능; EgoZero (2025) [25]: 스마트글래스만으로 7개 태스크 70% 성공. 촉각 도메인의 일반적 해법은 여전히 부재하나, 교차 체현 전이의 가능성은 빠르게 확장 중 | Ch10 |

| 7 | Multi-Modal Fusion Timing | 8+ | 시각 30Hz vs 촉각 1000Hz | Ch8, Ch11 |

| 8 | Safety in Human Proximity | 7+ | ISO/TS 15066 미충족 | Ch5 |

| 9 | Long-Horizon Task | 7+ | 5-30초 이상 error compounding | Ch8 |

| 10 | Evaluation Standardization | 6+ | 공인 벤치마크 부재 | Ch11 |

13.2 미래 연구 방향 (5개 그룹)

A. 센싱과 인지 (Sensing & Perception)

- 촉각 Foundation Model 확장: Sparsh 460K → 10x 이상 데이터 필요 (→ Ch3.6)

- 신경형태학적 센서: 스파이크 기반 인코딩, 이벤트 구동 (NRE-skin, Nature Comm. 2026) (→ Ch2.6)

- 자가 치유/자가 교정 센서: 산업 장기 운용 (→ Ch2.6)

- 센서 무관 표현: AnyTouch, Sensor-Invariant 방향 (→ Ch3.3)

- 전체 손 고밀도 촉각 커버리지: F-TAC Hand 방향의 표준화 (→ Ch2.4)

- 저가 소형 F/T 센서: CoinFT [Choi et al., 2024]가 6축 F/T 센싱을 <$10으로 달성했으나, 인장/박리력 취약성과 다양한 핸드 형태에 대한 표준 패키징 필요 [Choi, SNU 세미나 2026]

B. 학습과 제어 (Learning & Control)

- VLA + 촉각 일급 모달리티: ForceVLA [#1], Tactile-VLA 방향 (→ Ch8.4)

- 배치 후 RL로 지속 개선: pi0.6 [#4]/RECAP 패러다임 (→ Ch8.3)

- 1-shot / 0-shot 학습: 인터넷 비디오에서 (Human2Sim2Robot) (→ Ch6.5)

- 촉각 피드백 월드 모델: 모델 기반 계획 (→ Ch8.6)

- 장기 다지 태스크의 계층적 VLA: 오류 복구 포함 (→ Ch8.6)

C. 하드웨어와 설계 (Hardware & Design)

- $1K 이하 촉각 통합 다지 핸드: LEAP 비용 + F-TAC 센싱 (→ Ch4.2)

- 모듈형 교체 가능 센서 피부: AnySkin 12초 교체 방향 (→ Ch2.1.4)

- 안전-손재주 동시 최적화 VSA: 세미나 3 방향 (→ Ch5.2)

- 표준화된 핸드-센서 인터페이스: Digit Plexus 방향 (→ Ch4.6)

D. 데이터와 시뮬레이션 (Data & Simulation)

- 촉각 시뮬레이션 충실도 향상: DiffTactile, TacEx 방향 (→ Ch9.1)

- 대규모 합성 데이터 생성: NVIDIA 780K 궤적의 촉각 확장 (→ Ch9.6)

- 공유 촉각 데이터셋 확장: Touch-and-Go 3M → 100M+ (→ Ch3.5)

- 교차 체현 데이터 재활용: OXE for hands (→ Ch8.5)

- Egocentric 데이터 수집의 폭발적 성장: EgoDex (Apple, 2025) [26]는 829시간, 9,000만 프레임의 손 조작 데이터를, Ego4D (Meta) [27]는 3,670시간, 931명 참가자의 일인칭 비디오를 공개. 인간 egocentric 비디오가 로봇 학습의 핵심 데이터 소스로 부상하고 있습니다 (→ Ch6.5)

- 스케일링 법칙 기반 데이터 전략: EgoScale (NVIDIA, 2026) [21]이 발견한 log-linear 스케일링 법칙(R²=0.998)은 인간 데이터의 양을 체계적으로 늘리면 로봇 성능이 예측 가능하게 향상됨을 시사. 데이터 수집 투자의 ROI를 정량적으로 추정할 수 있는 근거를 제공합니다

E. 배치와 응용 (Deployment & Application)

- 인간 근접 정밀 조작의 안전 인증 (→ Ch12.3)

- 촉각 기반 품질 검사: 카메라에 보이지 않는 결함 (→ Ch12.4)

- 생산 속도의 변형 물체 조작: 섬유, 케이블, 식품 (→ Ch5.5)

- 다중 로봇 협업 조작: Helix 이중 로봇 (→ Ch12.6)

13.3 제조업 특화 과제 10가지

연구 시연 → 제조 현장의 격차는 대부분 3-5년입니다:

| 과제 | 심각도 | 예상 시점 | 관련 챕터 |

|---|---|---|---|

| 사이클 타임 매칭 | Critical | 3-5년 | Ch7, Ch8 |

| 24/7 다교대 신뢰성 | Critical | 2-4년 | Ch2, Ch4 |

| 안전 인증 (인간 협업) | Critical | 2-3년 | Ch5 |

| Sub-mm 조립 + 힘 제어 | High | 3-5년 | Ch7, Ch10 |

| 변형 물질 핸들링 | High | 2-4년 | Ch7, Ch5 |

| 도구 사용 (드라이버, 렌치) | High | 3-5년 | Ch7 |

| 현장 기술자 유지보수 | High | 2-4년 | Ch4, Ch12 |

| 혼합 소부품 빈 피킹 | Medium | 1-3년 | Ch7 |

| 촉각 기반 품질 검사 | Medium | 2-4년 | Ch2, Ch11 |

| 기존 자동화 대비 ROI | Medium | 진행 중 | Ch12 |

핵심 관찰: 현재 공장 배치(BMW, Amazon, Mercedes)는 물류 수준입니다. Dexterous assembly는 production 미도달. 책에서 이 capability level 차이를 명확히 구분했습니다.

13.4 우리의 연구 방향 제안

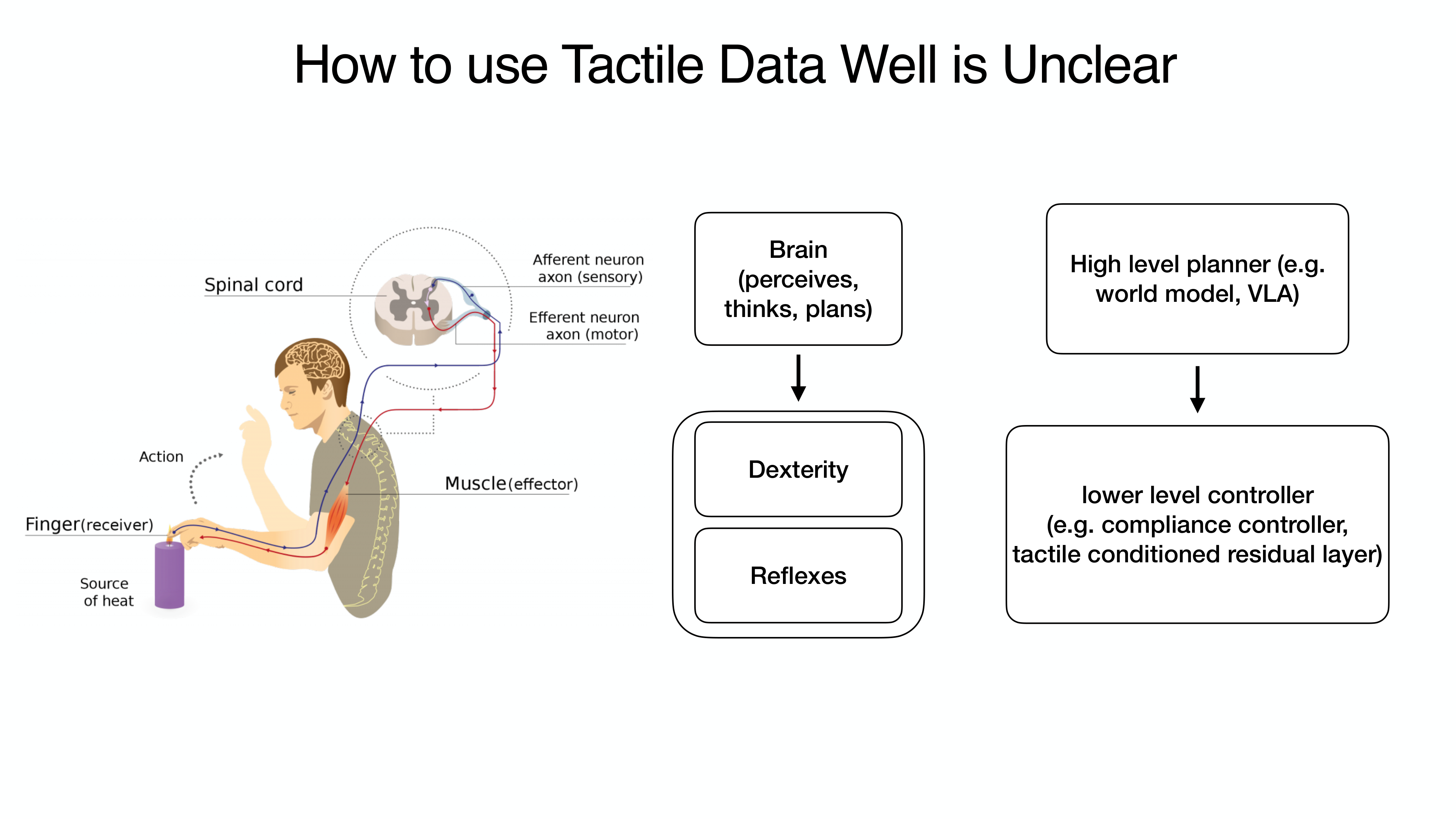

메커니즘 + 촉각 + 학습의 삼각 통합

이 책의 12개 챕터를 관통하는 핵심 통찰을 하나의 연구 방향으로 제안합니다:

축 1 — 메커니즘 (Physical Intelligence):

세미나 3의 지능형 메커니즘이 연속 접촉을 유도하면 (→ Chapter 5), 상태 안정성이 향상되고 제어가 단순화됩니다.

축 2 — 촉각 (Tactile Sensing):

연속 접촉 상태에서 촉각 센서가 접촉 상태를 인식하면 (→ Chapter 2), 더 정밀한 힘 제어와 미끄러짐 감지가 가능합니다. CoinFT의 ~360 Hz 다축 센싱과 ACP의 ~500 Hz 컴플라이언스 제어는 필요한 시간 해상도가 현재 하드웨어로 달성 가능함을 보여줍니다 [Choi, SNU 세미나 2026].

축 3 — 학습 (VLA/Diffusion):

안정적 접촉 상태에서의 촉각 피드백을 VLA/Diffusion Policy가 활용하면 (→ Chapter 7, 8), 학습의 샘플 효율성과 일반화가 향상됩니다. UMI-FT 실험 결과가 이를 검증합니다: in-the-wild 데이터로 훈련한 정책은 미지 환경에서 100% 성공한 반면, 연구실 내 데이터만으로는 20%에 그쳤습니다 — 확장 가능한 수집(축 2)이 학습(축 3)을 직접 향상시키는 것입니다 [Choi, SNU 세미나 2026].

핵심 명제: 메커니즘이 연속 접촉을 물리적으로 보장하고, 촉각이 접촉 상태를 인식하고, 학습이 이를 활용하면 — 각 축의 부담이 경감되며 전체 시스템의 견고성이 향상됩니다.

추가 연구 방향

- Shared Sensing Platform: OSMO [#18]/UniTacHand [#16] 방향의 교차 체현 촉각 전이 일반화 (→ Chapter 10.4)

- Factory-Specific Foundation Model: 공장 환경 특화 촉각-시각 Foundation Model (물성, 표면 상태)

- Open Hardware + Open Data: LEAP/ORCA 수준 저비용 핸드 + Touch100k 수준 데이터셋 확장

- 연속 접촉 기반 조작: 세미나 3의 독창적 인사이트 — 메커니즘이 연속 접촉을 유도하면 sensing/learning 부담 경감

2024-2026 핵심 발견: 반직관적 결과 세 가지

최근 연구들은 로봇 학습에 대한 기존의 가정을 뒤집는 반직관적 결과를 보고하고 있습니다:

- 1시간 인간 데이터 > 2시간 로봇 데이터: EgoMimic [22]은 인간 시연 1시간이 로봇 텔레오퍼레이션 2시간보다 +34-228% 높은 성능을 달성함을 보였습니다. 인간 데이터의 품질과 다양성이 로봇 데이터의 양을 압도합니다.

- 인간 데이터만으로 로봇 제어 가능: X-Sim [23]은 로봇 데이터 없이 인간 비디오만으로 실제 로봇 태스크를 성공시켰고, EgoZero [25]는 스마트글래스만으로 7개 태스크에서 70% 성공률을, VidBot [24]은 인터넷 비디오만으로 +20% zero-shot 성능 향상을 달성했습니다.

- Log-linear 스케일링: 인간 데이터 양 증가 → 성능 예측 가능하게 향상: EgoScale [21]은 20,854시간의 인간 데이터에서 R²=0.998의 log-linear 스케일링 법칙을 발견했습니다. 이는 대규모 언어 모델의 스케일링 법칙과 유사하며, 인간 데이터 수집에 대한 체계적 투자가 로봇 성능의 예측 가능한 향상으로 이어짐을 의미합니다.

시사점: 이 세 가지 발견은 "로봇 학습에는 로봇 데이터가 필수"라는 기존 패러다임에 도전합니다. 인간 egocentric 데이터의 대규모 수집과 교차 체현 전이가 촉각 로봇 공학의 데이터 병목을 해소할 핵심 경로가 될 수 있습니다.

요약: 이 책의 메시지

촉각은 로봇 조작의 마지막 퍼즐 조각입니다. 비전 기반 센서의 저비용화(GelSight → DIGIT $350 → Digit 360), 저비용 오픈소스 핸드의 민주화(Shadow $100K → LEAP $2K), 대규모 Foundation Model의 등장(RT-2 → pi0 → Gemini Robotics)이라는 세 흐름이 수렴하면서, 촉각 로봇 공학은 역사상 가장 빠른 속도로 발전하고 있습니다.

2026년 현재, 촉각은 더 이상 선택 사항이 아닙니다. 표준이 되고 있습니다.

그리고 이 표준을 제조 현장의 정밀 조작으로 전환하는 것이 — 이 책이 제안하는 "Physical AI for Manufacturing"의 핵심 과제입니다.

참고문헌

- Various. (2025). DeXtreme: Transfer of agile in-hand manipulation. ICRA 2023. scholar

- Various. (2025). Tactile Robotics: Past and Future. arXiv:2512.01106. scholar

- Bhirangi, R., et al. (2024). AnySkin: Plug-and-play skin sensing. ICRA 2025. scholar

- Zhao, Z., Li, W., Li, Y., Liu, T., Li, B., Wang, M., Du, K., Liu, H., Zhu, Y., Wang, Q., Althoefer, K., & Zhu, S.-C. (2025). Embedding high-resolution touch across robotic hands enables adaptive human-like grasping. Nature Machine Intelligence. https://doi.org/10.1038/s42256-025-01053-3 #39 scholar

- Various. (2025). NRE-skin. PNAS. scholar

- Various. (2026). Bioinspired spiking architecture. Nature Communications. scholar

- Yu, J., et al. (2025). ForceVLA: Enhancing VLA models with a force-aware MoE for contact-rich manipulation. NeurIPS 2025. #1 scholar

- Various. (2025). Tactile-VLA. OpenReview. scholar

- Physical Intelligence. (2025). pi0.5/RECAP: Post-deployment RL for continuous improvement. arXiv preprint. arXiv:2504.16932. #4 scholar

- Shaw, K., et al. (2024). Learning from internet videos. CMU. scholar

- Si, Z., Zhang, G., Ben, Q., Romero, B., Xian, Z., Liu, C., & Gan, C. (2024). DiffTactile: A physics-based differentiable tactile simulator. ICLR 2024. scholar

- Various. (2024). TacEx: GelSight tactile simulation in Isaac Sim. arXiv preprint. arXiv:2411.04776. scholar

- NVIDIA. (2026). 780K trajectories in 11 hours. GTC 2026. scholar

- Various. (2025). OSMO. arXiv:2512.08920. #18 scholar

- Zhang, Y., et al. (2025). UniTacHand. Various. #16 scholar

- Bicchi, A. (2000). Hands for dexterous manipulation. IEEE T-RA. scholar

- Billard, A., & Kragic, D. (2019). Trends and challenges. Science. scholar

- Various. (2026). VLA systematic review. Information Fusion. scholar

- Various. (2025). What matters in building VLA models. Nature MI. scholar

- Hogan, N. (1985). Impedance control. JDSMC. scholar

- Bansal, A., et al. (2026). EgoScale: Scaling laws for egocentric human data in robot learning. arXiv preprint. NVIDIA Research. scholar

- Kareer, S., et al. (2024). EgoMimic: Scaling imitation learning via egocentric video. arXiv preprint. Georgia Tech. scholar

- Rishabh, A., et al. (2025). X-Sim: Cross-embodiment simulation for robot learning. CoRL 2025 (Oral). Cornell University. scholar

- Bahl, S., et al. (2025). VidBot: Learning robot policies from internet videos. CVPR 2025. TU Munich. scholar

- Wang, Y., et al. (2025). EgoZero: Robot learning from smart glasses demonstrations. arXiv preprint. scholar

- Apple ML Research. (2025). EgoDex: Learning dexterous manipulation from large-scale egocentric video. 829 hours, 90M frames. arXiv preprint. scholar

- Grauman, K., et al. (2022). Ego4D: Around the world in 3,000 hours of egocentric video. CVPR 2022. Meta AI. 3,670 hours, 931 participants. scholar