Chapter 6: 사람 손 데이터 수집 — 시연으로 가르치기

개요

로봇에게 조작을 가르치는 가장 직관적인 방법은 인간의 시연(demonstration)을 보여주는 것입니다. 그러나 인간 손의 27 DoF 동작과 촉각 정보를 로봇에 전달하는 것은 근본적인 도전입니다. 이 챕터에서는 인간 손 모델링(MANO [#17]), 모션 트래킹 글로브, 촉각 글로브, 외골격, 원격 조작 시스템을 다루며, "사람에서 로봇으로"의 데이터 파이프라인을 조망합니다.

이 챕터를 읽고 나면... - MANO 손 모델의 구조와 활용을 설명할 수 있습니다. - 주요 모션 트래킹 글로브의 특성을 비교할 수 있습니다. - 촉각 글로브(STAG, OSMO [#18])의 설계와 교차 체현 잠재력을 이해합니다. - 외골격과 원격 조작의 장단점을 파악합니다.

6.1 인간 손 모델: MANO (778 정점, 16 관절)

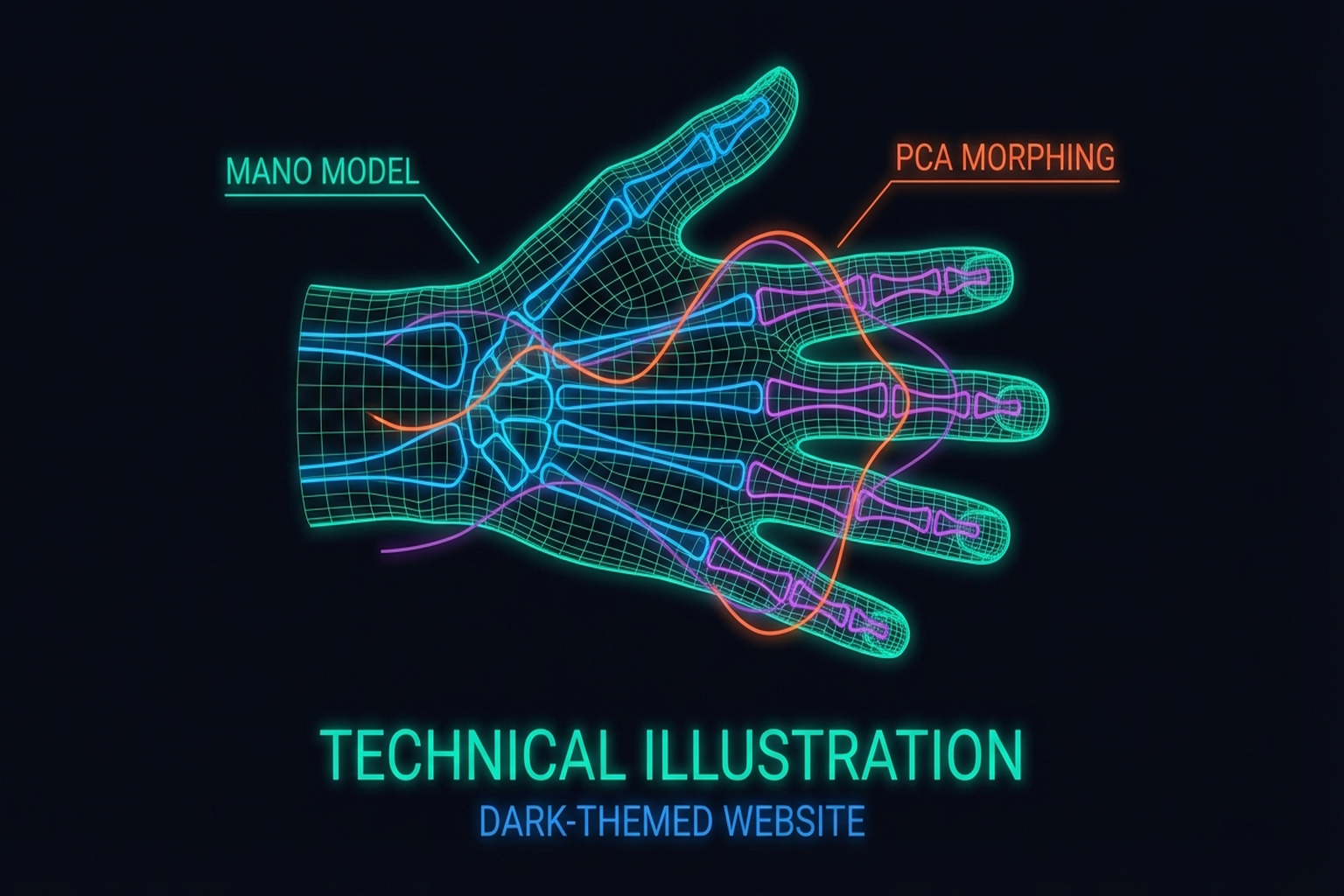

MANO [1]는 1,000개의 3D 스캔으로 학습한 통계적 인간 손 모델입니다 (SIGGRAPH Asia 2017):

- 778 정점(vertices), 16 관절(joints)

- PCA 형상 공간(shape space): 개인 간 손 크기/형태 변이를 저차원으로 표현

- 포즈 블렌드 쉐이프(pose blend shapes): 관절 각도에 따른 피부 변형 모델링

- SMPL 전신 모델과 통합 가능 (SMPL+H)

MANO는 사실상 모든 인간 손 관련 연구의 기초 모델입니다. 손 자세 추정(hand pose estimation), 인간-로봇 리타게팅(retargeting), 촉각 전이(UniTacHand의 MANO UV 맵)에서 핵심 역할을 합니다 (→ Chapter 10.4 참조).

6.2 모션 트래킹 글로브: 신축성 센서에서 상용 제품까지

세미나 2 (Taejoon)는 모션 트래킹 글로브의 현황을 체계적으로 리뷰했습니다.

신축성 액체 금속 센서 글로브 (2024)

Nature Communications[2]에 발표된 이 글로브는:

- 9개의 eGaIn(유텍틱 갈륨-인듐) 액체 금속 센서

- 9 DoF 추적, 모든 손 크기에 적응 (one-size-fits-all)

- 관절 각도 오차: 4.16°, 손끝 위치 오차: 4.02mm

- 베이지안 보정(Bayesian refinement) + 칼만 필터(Kalman filter)

핵심 논문: Various. (2024). "Stretchable Liquid-Metal Sensor Glove." Nature Communications. 9개 eGaIn 센서로 모든 손 크기에 적응하는 모션 트래킹 글로브. 4.02mm 손끝 오차는 대부분의 조작 시연에 충분한 정밀도입니다.

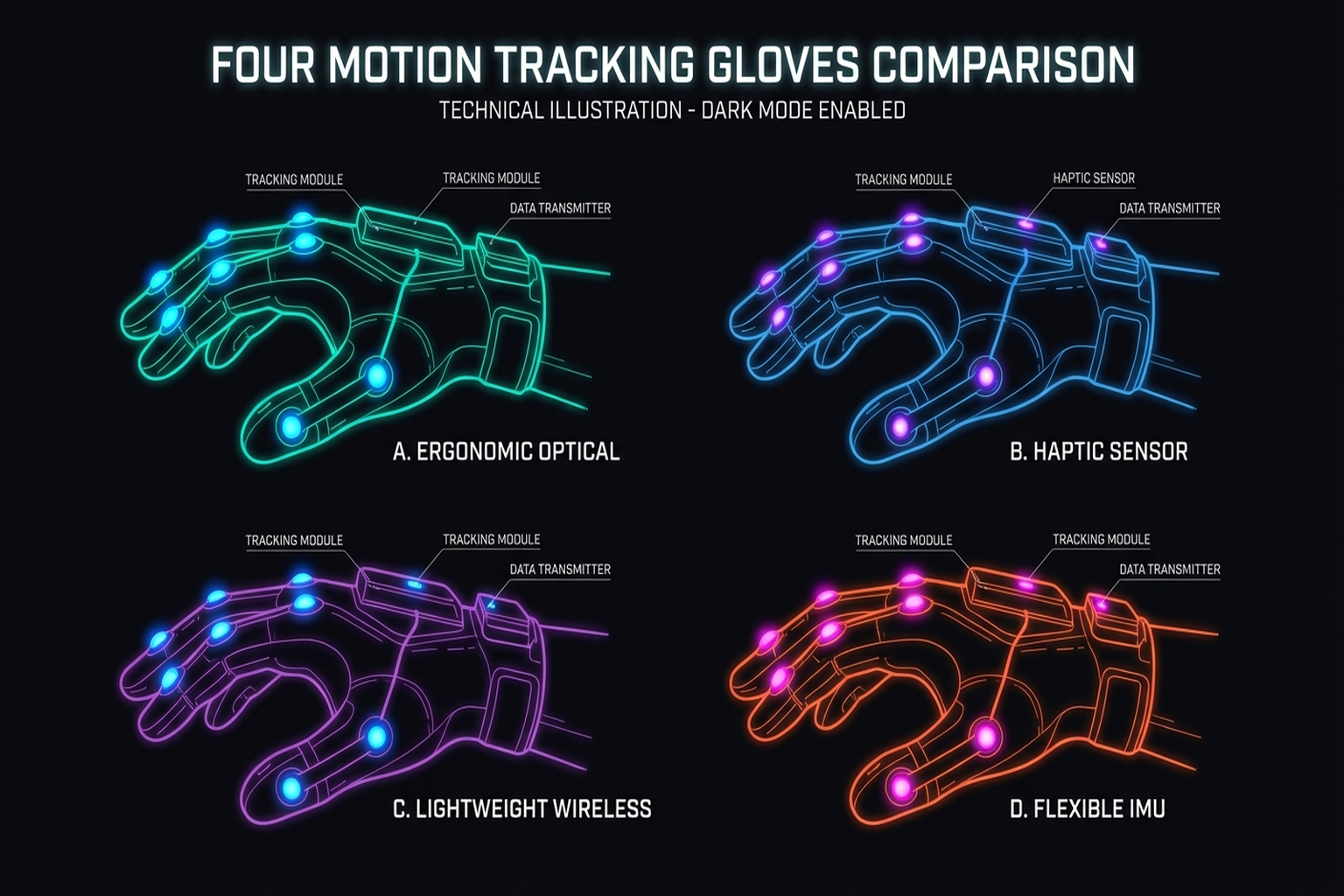

상용 글로브 비교

세미나 2는 세 가지 상용 글로브를 비교했습니다:

| 글로브 | 센서 방식 | 센서 수 | DoF | 특징 |

|---|---|---|---|---|

| Rokoko | IMU | 7 | 6 | 가장 가벼운 솔루션 |

| Manus | Stretch/flex | 16 | — | NVIDIA Isaac Teleop 공식 글로브 (GTC 2026) |

| StretchSense | EMF (전자기장) | — | 25 | 가장 높은 DoF |

NVIDIA가 GTC 2026에서 Manus를 Isaac Teleop의 공식 데이터 글로브로 지정한 것은 산업 표준화의 신호입니다.

한국 연구: ML 기반 착용형 센서

Seoul National University의 연구 [2024, PMC]는 ML 기반 착용형 센서로 실시간 손 동작 인식을 구현하여, 실험실과 실용 환경 사이의 격차를 줄이고 있습니다.

6.3 촉각 글로브: STAG, OSMO와 오픈소스 접근

모션 트래킹을 넘어, 인간이 물체를 잡을 때의 촉각 정보까지 수집하는 것이 다음 단계입니다.

STAG (2019)

Sundaram et al. [3]의 STAG 글로브 (Nature, 2019):

- 548개 압저항 센서: 인간 손의 압력 분포를 고해상도로 측정

- 파지-손가락 상관관계(grasp-finger correlation) 분석

- 로봇 학습을 위한 촉각 시연 데이터셋 구축의 선구적 사례

Ruppel et al.[21]은 169개 센서로 축소된 버전을 제안하여, 센서 수와 정보 손실의 트레이드오프를 탐구했습니다.

OSMO 글로브 (2025)

OSMO [arXiv:2512.08920]는 인간과 로봇 손에 동일한 글로브를 사용하는 혁신적 접근입니다:

- 12개 3축 자기 센서: 법선력 + 전단력 동시 측정

- MuMetal 차폐로 외부 자기장 간섭 억제

- 핵심 개념 — Embodiment Bridge: 인간/로봇에 동일 센싱 글로브를 사용하면 교차 체현(cross-embodiment) 문제가 단순화됨

- 오픈소스: 재현 가능한 설계

핵심 논문: OSMO. (2025). "OSMO: Open-Source Multi-axis Tactile Glove." arXiv:2512.08920. 인간과 로봇 손 모두에 사용 가능한 12개 3축 자기 촉각 글로브. 교차 체현 촉각 전이의 새로운 패러다임을 제시합니다.

세미나 2의 핵심 인사이트: 인간/로봇에 동일 센싱 글로브를 사용하면 cross-embodiment 문제 단순화. 인간의 시연에서 촉각 데이터를 수집하고, 같은 글로브를 로봇 손에 장착하여 정책을 학습하면, 촉각 도메인 갭(tactile domain gap)이 제거됩니다 (→ Chapter 10.4 참조).

TacCap (2025)

TacCap [arXiv, Mar 2025]은 FBG(Fiber Bragg Grating) 광학 촉각 센서를 손가락 끝 골무(thimble) 형태로 구현한 시스템입니다:

- FBG 광섬유 기반 촉각 센서: 높은 감도와 빠른 응답 속도

- 인간/로봇 양쪽 장착 가능: OSMO와 유사한 교차 체현 접근

- EMI 면역(electromagnetic interference immune): 광학 기반이므로 전자기 간섭에 완전 면역 — MRI 환경이나 강한 전자기장 근처에서도 사용 가능

- 골무 형태로 기존 글로브나 로봇 핑거팁에 쉽게 부착

TacCap은 OSMO의 자기 센서와 보완적인 위치에 있습니다. 자기 센서가 외부 자기장에 취약한 환경에서는 FBG 광학 방식이 대안이 됩니다.

VTDexManip (2025)

VTDexManip [ICLR 2025]은 최초의 대규모 visual-tactile 인간 시연 데이터셋입니다:

- 565,000 프레임: 시각(visual)과 촉각(tactile) 정보를 동시에 수집

- 10개 태스크, 182개 물체: 다양한 조작 시나리오를 포괄

- 최초의 visual-tactile 인간 시연 데이터셋: 기존 데이터셋이 시각 또는 촉각 중 하나만 제공한 반면, 두 모달리티를 통합

- 교차 체현 정책 학습을 위한 벤치마크 역할

VTDexManip은 "촉각 글로브로 수집한 시연 데이터를 어떻게 활용할 것인가"에 대한 구체적 답을 제공합니다. 565K 프레임은 대규모 모방 학습(imitation learning)에 충분한 규모입니다.

FSR 최적화 접근

Tang et al.[5]과 Chen et al.[5]은 FSR(Force Sensing Resistor) 센서의 최적 배치 문제를 다루어, 제한된 센서 수로 최대 정보를 추출하는 방법을 탐구했습니다. 이는 "고공간 해상도 vs 최적화된 센서 수/위치"의 트레이드오프에 대한 답입니다.

6.4 외골격 접근: DexUMI [#8], ExoStart [#9], DEXOP [#10]

외골격(exoskeleton)은 인간 손에 기계적으로 연결되어 동작을 직접 캡처하는 접근입니다.

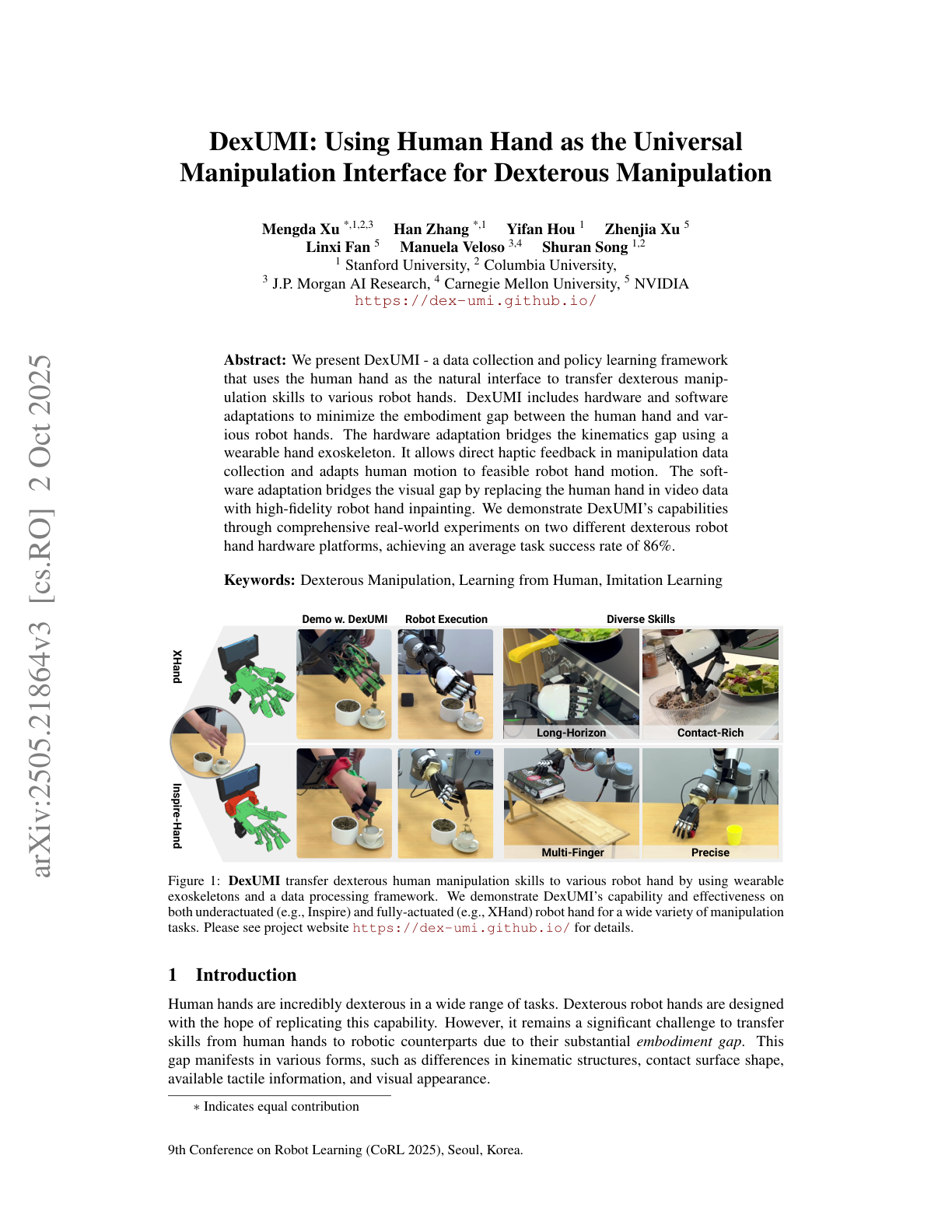

DexUMI (2025)

Xu et al.[5]의 DexUMI는 "인간 손을 범용 인터페이스로":

- 착용형 외골격으로 운동학적 격차(kinematic gap) 해소

- SAM2 인페인팅(inpainting)으로 시각적 격차(visual gap) 해소 — 카메라 이미지에서 인간 손을 지우고 로봇 손으로 대체

- Inspire, XHand에서 86% 성공률

- 원격 조작 대비 3.2배 빠른 데이터 수집

ExoStart (2025)

Si et al.[5]의 ExoStart는 10회 외골격 시연만으로 다지 조작 정책을 학습합니다:

- ~10 exoskeleton demos

- MuJoCo dynamics filtering

- Auto-curriculum RL

- ACT vision student

- Zero-shot real → 7개 태스크 중 6개에서 >50% 성공률

이 파이프라인은 Real-Sim-Real 전이의 대표적 사례입니다 (→ Chapter 9.4 참조).

DEXOP (2025)

DEXOP[8]은 4절 링크(4-bar linkage)로 인간 손가락과 로봇 손가락을 직접 기계적으로 연결합니다:

- 원격 조작 대비 8배 빠른 데이터 수집

- 직접 접촉 피드백(direct contact feedback) 제공

- 51.3% vs 42.5% (원격 조작 대비) 성공률

AirExo / AirExo-2 (SJTU, 2024–2025)

AirExo [ICRA 2024]와 AirExo-2 [CoRL 2025]는 Shanghai Jiao Tong University에서 개발한 저비용 패시브 외골격입니다:

- 약 $300의 제작 비용: 3D 프린팅 부품과 저가 센서로 구성

- 패시브 구동(passive): 모터 없이 인간 동작을 직접 기록

- "in-the-wild" 인간 시연 수집: 실험실 밖 일상 환경에서 데이터 수집 가능

- AirExo-2의 핵심 발견: 3분 텔레옵 + in-the-wild 데이터 ≥ 20분 텔레옵 단독 — 값비싼 원격 조작 데이터를 자연 환경 시연으로 대체할 수 있음을 실증

- 팔(arm) + 손(hand)을 모두 커버하는 전신 상지 외골격

AirExo 시리즈는 데이터 수집의 민주화를 보여주는 대표적 사례입니다. $300 외골격으로 수집한 in-the-wild 데이터가 고가의 원격 조작 데이터를 보완하거나 대체할 수 있다는 결과는, 로봇 학습 데이터의 확장성 문제에 새로운 해법을 제시합니다.

ACE (UCSD, CoRL 2024)

ACE [CoRL 2024]는 University of California San Diego에서 개발한 범용 원격 조작 인터페이스입니다:

- Hand-facing camera + 외골격: 손 방향 카메라로 손가락 자세를 추적하고 외골격으로 팔 동작을 캡처

- 단일 시스템으로 다양한 로봇 플랫폼 지원: humanoid, robot arm, gripper, quadruped 모두 텔레옵 가능

- 체현 간 전환이 소프트웨어 수준에서 이루어져 하드웨어 교체 불필요

- 직관적 조작: 인간의 자연스러운 동작이 로봇 동작으로 즉시 매핑

ACE의 핵심 기여는 하나의 인터페이스로 모든 로봇을 조작할 수 있다는 것입니다. 이는 수집한 인간 시연 데이터의 재활용성을 극대화합니다.

NuExo (Nubot Lab, ICRA 2025)

NuExo [ICRA 2025]는 Nubot Lab에서 개발한 능동(active) 외골격 시스템입니다:

- 5.2kg 백팩형 능동 외골격: 모터 구동으로 햅틱 피드백 제공

- 100% 상지 ROM(Range of Motion): 인간 상지의 전체 운동 범위를 제한 없이 캡처

- 2.5mm 나사 조이기 성공: 극도로 정밀한 조작 태스크를 원격으로 수행

- 백팩 형태로 이동성 확보, 다양한 환경에서 사용 가능

NuExo는 패시브 외골격(AirExo)과 반대 방향의 접근입니다. 능동 구동과 햅틱 피드백으로 정밀도의 상한을 끌어올려, 미세 조작(fine manipulation) 시연 수집에 특화되어 있습니다.

HumanoidExo (NUDT, 2025)

HumanoidExo [arXiv, Oct 2025]는 National University of Defense Technology(NUDT)에서 개발한 전신 외골격입니다:

- 경량 외골격 + LiDAR: 외골격으로 상체/팔 동작을, LiDAR로 하체/보행 궤적을 캡처

- 전신 궤적(full-body trajectory) 수집: 상지 조작과 하지 이동을 동시에 기록

- 외골격 데이터만으로 보행 학습: 별도의 보행 시뮬레이션 없이 인간 시연 데이터로 직접 정책 학습

- 휴머노이드 로봇의 전신 원격 조작에 최적화

HumanoidExo는 외골격의 응용 범위를 손/팔에서 전신으로 확장한 사례입니다. 휴머노이드 로봇이 상용화되는 시점에서, 전신 시연 수집 인프라의 중요성이 부각되고 있습니다.

핵심 관점: DexUMI, ExoStart, DEXOP는 각각 다른 방식으로 인간-로봇 격차를 메우지만, 공통적으로 원격 조작의 처리량 병목(~10 demos/hr)을 극복하려는 시도입니다. AirExo는 비용 장벽을, ACE는 플랫폼 호환성을, NuExo는 정밀도를, HumanoidExo는 전신 적용을 해결합니다.

6.5 대규모 데이터: 인터넷 비디오에서 에고센트릭 캡처까지

Shaw et al. [2024, CMU]은 인터넷 비디오에서 인간 손 동작을 추출하고 로봇 핸드로 리타게팅하는 접근을 제안했습니다. 이 접근의 잠재력은 확장성(scalability)에 있습니다 — 인터넷에는 수백만 개의 손 조작 비디오가 있으며, 이를 로봇 학습 데이터로 변환할 수 있다면 원격 조작의 병목을 근본적으로 해결할 수 있습니다.

ImMimic [14]은 대규모 인간 궤적(human trajectory)과 소수의 원격 조작 궤적(teleoperation trajectory)을 보간(interpolation)하여 데이터를 증강(augment)합니다. 세미나 1에서 논의된 바와 같이, 이 접근은 비싼 teleop data 대신 human data를 시너지적으로 활용하는 방향을 대표합니다 (→ Chapter 10.2 참조).

DexH2R[15]은 태스크 지향 인간-로봇 다지 전이(task-oriented human-to-robot dexterous transfer)를 구현하여, 인간 시연의 의도를 로봇 동작으로 매핑합니다.

EgoDex (Apple, 2025)

EgoDex [Apple, 2025]는 Apple Vision Pro와 ARKit을 활용한 대규모 에고센트릭(egocentric) 손 조작 데이터셋입니다:

- 829시간, 90M(9,000만) 프레임: 현존 최대 규모의 손 조작 데이터셋

- 194개 태스크: 일상 물체 조작부터 도구 사용까지 광범위한 시나리오

- 30Hz per-finger tracking: ARKit의 손 추적으로 각 손가락의 3D 궤적을 실시간 기록

- 소비자 하드웨어(Apple Vision Pro)로 수집하여 확장성 확보

EgoDex는 인터넷 비디오 접근과 원격 조작 접근 사이의 새로운 중간 지대를 개척합니다. 비디오처럼 대규모이면서도 원격 조작처럼 정확한 3D 손가락 궤적을 제공합니다. 829시간이라는 규모는 기존 로봇 시연 데이터셋을 수십 배 초과하며, Foundation Model 학습에 필요한 데이터 규모에 근접합니다.

6.6 원격 조작: AnyTeleop, DexPilot, Bunny-VisionPro

원격 조작(teleoperation)은 가장 전통적이면서도 데이터 품질이 가장 높은 수집 방법입니다.

AnyTeleop (2023)

Qin et al. [2023, RSS]의 AnyTeleop은 범용 비전 기반 원격 조작 시스템입니다:

- Dex-Retarget: 인간 키포인트를 로봇 관절 위치로 매핑

- 다양한 로봇 핸드와 호환

- 세미나 1에서 논의된 naive 리타게팅의 한계 — 인간과 로봇의 운동학적 차이로 인한 물리적 타당성(physical feasibility) 상실

DexPilot (2020)

Handa & Van Wyk [2020, NVIDIA]의 DexPilot은 맨 손(bare hand)의 깊이 영상(depth image)으로 23-DOA 원격 조작을 구현합니다. 별도 장비 없이 RGB-D 카메라만으로 작동하여 접근성이 높습니다.

Bunny-VisionPro (2024)

Ding et al. [2024, UCSD]은 Apple Vision Pro를 이용한 양손 원격 조작 시스템을 구현하여, 소비자용 하드웨어로 연구급 원격 조작을 달성합니다. 햅틱 피드백을 포함하여 조작자에게 접촉 정보를 되돌려줍니다.

DexCap (2024)

Wang et al. [2024, Stanford]의 DexCap은 휴대용 모션 캡처 시스템으로, 원격 조작 대비 3배 빠른 데이터 수집을 가능하게 하며, 30분 데이터로 정책 학습이 가능합니다.

DOGlove (2025)

저비용 오픈소스 햅틱 피드백 글로브로, 조작자에게 촉각 피드백을 제공하여 원격 조작의 품질을 향상시킵니다.

Feel Robot Feels (2026)

촉각 피드백 어레이 글로브로 햅틱 루프를 완성하여, 조작자가 로봇이 느끼는 접촉을 직접 감지할 수 있습니다.

UMI-FT [Choi et al., 2025]는 이 스펙트럼에서 독특한 위치를 차지합니다: 인간의 손재주를 보존하면서 자연스러운 햅틱 피드백(원격 조작 지연 없음)을 제공하고, CoinFT 센서로 6축 힘/토크 데이터를 수집하며, 야외 환경까지 확장 가능합니다. 수백 명이 로봇이나 훈련된 조작자 없이 매일 시연 데이터를 수집할 수 있습니다. 장치가 로봇의 그리퍼 형태를 모방하므로 체화 격차(embodiment gap)도 작습니다 [Choi, SNU 세미나 2026].

| 시스템 | 입력 장치 | 햅틱 피드백 | 처리량 | 비용 |

|---|---|---|---|---|

| AnyTeleop | RGB 카메라 | 없음 | 기준 | 낮음 |

| DexPilot | RGB-D 카메라 | 없음 | 기준 | 낮음 |

| Bunny-VisionPro | Vision Pro | 있음 | 기준 | 중간 |

| DexCap | 모션 캡처 | 없음 | 3x | 중간 |

| DexUMI | 외골격 | 직접 접촉 | 3.2x | 중간 |

| DEXOP | 4절 링크 | 직접 접촉 | 8x | 낮음 |

| AirExo | 패시브 외골격 | 없음 | 높음 (in-the-wild) | 매우 낮음 (~$300) |

| ACE | 카메라+외골격 | 없음 | 기준 | 중간 |

| NuExo | 능동 외골격 | 있음 (햅틱) | 기준 | 높음 |

| EgoDex | Vision Pro + ARKit | 없음 | 매우 높음 (829h) | 중간 |

| 인터넷 비디오 | 없음 (관찰) | 없음 | 무제한 | 매우 낮음 |

요약 및 전망

인간 손 데이터 수집은 처리량(throughput)과 데이터 품질(quality)의 트레이드오프 위에 있습니다. 원격 조작은 높은 품질을 제공하지만 ~10 demos/hr로 확장이 어렵고, 인터넷 비디오는 무제한 확장이 가능하지만 동작 라벨과 촉각 정보가 부재합니다. OSMO 글로브의 Embodiment Bridge 접근과 DEXOP의 기계적 직접 결합은 이 트레이드오프의 새로운 해법을 제시합니다.

AirExo의 $300 패시브 외골격과 EgoDex의 829시간 Vision Pro 데이터셋은 데이터 수집의 민주화와 대규모화라는 두 축을 동시에 추진하고 있습니다. 또한 VTDexManip의 565K 프레임 visual-tactile 데이터셋과 TacCap의 EMI-면역 FBG 센서는 촉각 정보를 포함한 시연 수집의 실용화를 앞당기고 있습니다.

NVIDIA Isaac Teleop + MANUS의 산업 표준화, 인터넷 비디오 마이닝의 확장, 그리고 합성 데이터(780K 궤적/11시간)의 촉각 확장이 데이터 병목을 해소할 핵심 방향입니다.

다음 챕터에서는 이렇게 수집된 데이터로 로봇이 조작을 학습하는 방법을 다룹니다 (→ Chapter 7: 조작 학습 참조).

참고문헌

- Romero, J., Tzionas, D., & Black, M. J. (2017). Embodied hands: Modeling and capturing hands and bodies together. SIGGRAPH Asia 2017. scholar

- Various. (2024). Stretchable liquid-metal sensor glove. Nature Communications. https://doi.org/10.1038/s41467-024-50101-w scholar

- Sundaram, S., Kellnhofer, P., Li, Y., Zhu, J.-Y., Torralba, A., & Matusik, W. (2019). Learning the signatures of the human grasp using a scalable tactile glove. Nature, 569, 698-702. scholar

- Ruppel, P., et al. (2024). Reduced tactile sensor array for grasp analysis. Sensors. scholar

- Yin, J., Qi, H., Wi, Y., Kundu, S., Lambeta, M., Yang, W., Wang, C., Wu, T., Malik, J., & Hellebrekers, T. (2025). OSMO: Open-source tactile glove for human-to-robot skill transfer. arXiv preprint. arXiv:2512.08920. #18 scholar

- Xu, M., Zhang, H., Hou, Y., Xu, Z., Fan, L., Veloso, M., & Song, S. (2025). DexUMI: Using human hand as the universal manipulation interface for dexterous manipulation. arXiv preprint. arXiv:2505.21864. #8 scholar

- Si, Z., Qian, K., Sontakke, N., et al. (2025). ExoStart: Efficient learning for dexterous manipulation with sensorized exoskeleton demonstrations. arXiv preprint. arXiv:2506.11775. #9 scholar

- Fang, H.-S., Romero, B., Xie, Y., Hu, A., Huang, B.-R., Alvarez, J., Kim, M., Margolis, G., Anbarasu, K., Tomizuka, M., Adelson, E., & Agrawal, P. (2025). DEXOP: A device for robotic transfer of dexterous human manipulation. arXiv preprint. arXiv:2509.04441. #10 scholar

- Qin, Y., et al. (2023). AnyTeleop: A general vision-based dexterous robot hand-arm teleoperation system. RSS 2023. scholar

- Handa, A., & Van Wyk, K. (2020). DexPilot: Vision-based teleoperation for dexterous manipulation. ICRA 2020. scholar

- Ding, Z., et al. (2024). Bunny-VisionPro: Real-time bimanual dexterous teleoperation for imitation learning. arXiv preprint. arXiv:2407.03162. scholar

- Wang, C., et al. (2024). DexCap: Scalable and portable mocap data collection system. RSS 2024. scholar

- Shaw, K., Bahl, S., & Pathak, D. (2024). Learning dexterity from human hand motion in internet videos. arXiv preprint. arXiv:2212.04498. scholar

- Liu, Y., et al. (2025). ImMimic: Cross-domain imitation from human videos via mapping and interpolation. arXiv preprint. scholar

- Li, Y., et al. (2024). DexH2R: Task-oriented dexterous manipulation from human to robots. arXiv preprint. arXiv:2411.04428. scholar

- Zhang, H., Hu, S., Yuan, Z., & Xu, H. (2025). DOGlove: Dexterous manipulation with a low-cost open-source haptic force feedback glove. RSS 2025. arXiv:2502.07730. scholar

- Various. (2026). Feel Robot Feels: Tactile feedback array glove for dexterous manipulation. arXiv preprint. arXiv:2603.28542. scholar

- Murphy, L., et al. (2025). Capacitive tactile sensing for teaching by demonstration. arXiv preprint. scholar

- Tang, M., et al. (2025). FSR sensor optimization for grasp classification. IEEE Journal of Biomedical and Health Informatics. scholar

- Chen, H., et al. (2025). Capacitive sensor for lift-risk identification. Applied Ergonomics. scholar

- Various. (2024). ML-based wearable sensors for real-time hand motion recognition. PMC. (Seoul National University) scholar

- TacCap. (2025). TacCap: FBG optical tactile sensor thimble for human and robot fingertips. arXiv preprint, Mar 2025. scholar

- VTDexManip. (2025). VTDexManip: A large-scale visual-tactile dataset for dexterous manipulation from human demonstrations. ICLR 2025. scholar

- Fang, J., et al. (2024). AirExo: Low-cost exoskeletons for learning whole-arm manipulation in the wild. ICRA 2024. scholar

- Fang, J., et al. (2025). AirExo-2: Scaling up generalizable manipulation skills via purely kinesthetic demonstrations in the wild. CoRL 2025. scholar

- Zhao, Q., et al. (2024). ACE: A cross-platform visual-exoskeleton system for low-cost dexterous teleoperation. CoRL 2024. scholar

- NuExo. (2025). NuExo: A 5.2kg active upper-limb exoskeleton for dexterous teleoperation with 100% ROM. ICRA 2025. scholar

- HumanoidExo. (2025). HumanoidExo: Lightweight exoskeleton with LiDAR for full-body humanoid teleoperation and locomotion learning. arXiv preprint, Oct 2025. scholar

- EgoDex. (2025). EgoDex: Learning dexterous manipulation from large-scale egocentric hand data via Apple Vision Pro. Apple, 2025. scholar