Chapter 9: Sim-to-Real 전이 — 가상에서 현실로

개요

시뮬레이션에서 학습한 정책을 실제 로봇에 전이하는 Sim-to-Real 전이는 촉각 기반 조작의 핵심 도전입니다. 시각 sim-to-real보다 촉각 sim-to-real이 본질적으로 더 어렵습니다 — 젤 변형, 다중 물리(multi-physics) 결합, 접촉 모델의 충실도 한계 때문입니다. 이 챕터에서는 시뮬레이션 엔진, 도메인 랜덤화, 촉각 sim-to-real, Real-Sim-Real 루프를 다룹니다.

이 챕터를 읽고 나면... - 주요 촉각 시뮬레이션 엔진(Isaac Gym, MuJoCo, Tacto, DiffTactile)을 비교할 수 있습니다. - DeXtreme의 ADR(자동 도메인 랜덤화) 접근을 설명할 수 있습니다. - 촉각 sim-to-real의 고유한 도전을 이해합니다. - Real-Sim-Real 루프의 개념과 대표 사례를 파악합니다.

9.1 시뮬레이션 엔진: Isaac Gym/Lab, MuJoCo, Tacto, DiffTactile

Isaac Gym / Isaac Lab

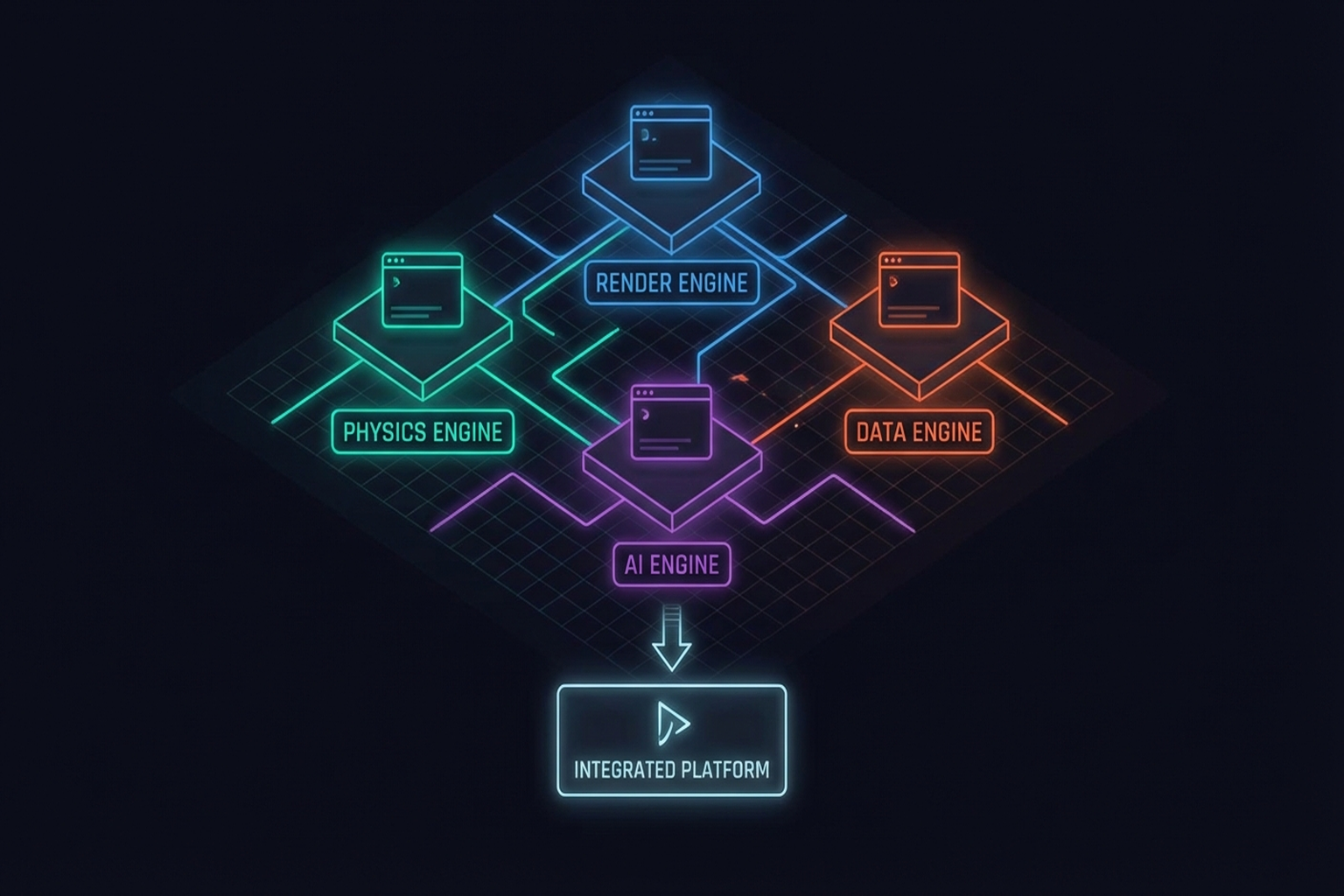

NVIDIA의 Isaac 생태계는 GPU 가속 물리 시뮬레이션의 표준입니다:

- GPU 병렬 시뮬레이션: 수천 환경을 동시 실행

- Isaac Sim/Lab: 시뮬레이션 + 학습 통합 플랫폼

- Newton 물리 엔진: 높은 충실도 접촉 모델

- Omniverse: 디지털 트윈

- DeXtreme[1], GR00T[12]의 핵심 플랫폼

MuJoCo

DeepMind의 MuJoCo는 접촉이 풍부한 시뮬레이션에 강점을 가집니다:

Tacto (2022)

Meta FAIR의 Tacto [3]는 비전 기반 촉각 센서 시뮬레이터입니다:

- PyRender + PyBullet 기반

- GelSight, DIGIT 등 비전 기반 센서의 합성 촉각 이미지 생성

- Sim-to-real 촉각 학습 가능

- 150회+ 인용

DiffTactile (2024)

미분 가능한 촉각 시뮬레이터:

- 기울기 기반 최적화(gradient-based optimization) 지원

- 접촉이 풍부한 조작의 미분 가능 시뮬레이션

- FEM 기반 변형 모델링

TacEx (2024)

TacEx는 GelSight 시뮬레이션을 Isaac Sim에 통합하여, 연구 워크플로우 전체(센서 시뮬레이션 → 정책 학습 → 전이)를 하나의 플랫폼에서 수행할 수 있게 합니다 (→ Chapter 11.2 참조).

| 엔진 | GPU 가속 | 촉각 지원 | 미분 가능 | 주요 용도 | 대표 사례 |

|---|---|---|---|---|---|

| Isaac Gym/Lab | 예 | 간접 (센서 모델) | 아니오 | RL 대규모 학습 | DeXtreme, GR00T |

| MuJoCo | 아니오 | 간접 | 아니오 | 접촉 풍부 시뮬레이션 | ExoStart, Dactyl |

| Tacto | 아니오 | 예 (비전 기반) | 아니오 | 촉각 이미지 생성 | DIGIT sim-to-real |

| DiffTactile | 부분적 | 예 | 예 | 기울기 최적화 | 접촉 최적화 |

| TacEx | 예 | 예 (GelSight) | 아니오 | 통합 워크플로우 | 연구 파이프라인 |

9.2 도메인 랜덤화: DeXtreme의 ADR

Sim-to-real 격차를 극복하는 가장 널리 사용되는 전략은 도메인 랜덤화(Domain Randomization, DR)입니다 — 시뮬레이션의 물리 파라미터를 랜덤으로 변화시켜 정책이 다양한 조건에 견고해지도록 합니다.

DeXtreme (2023)

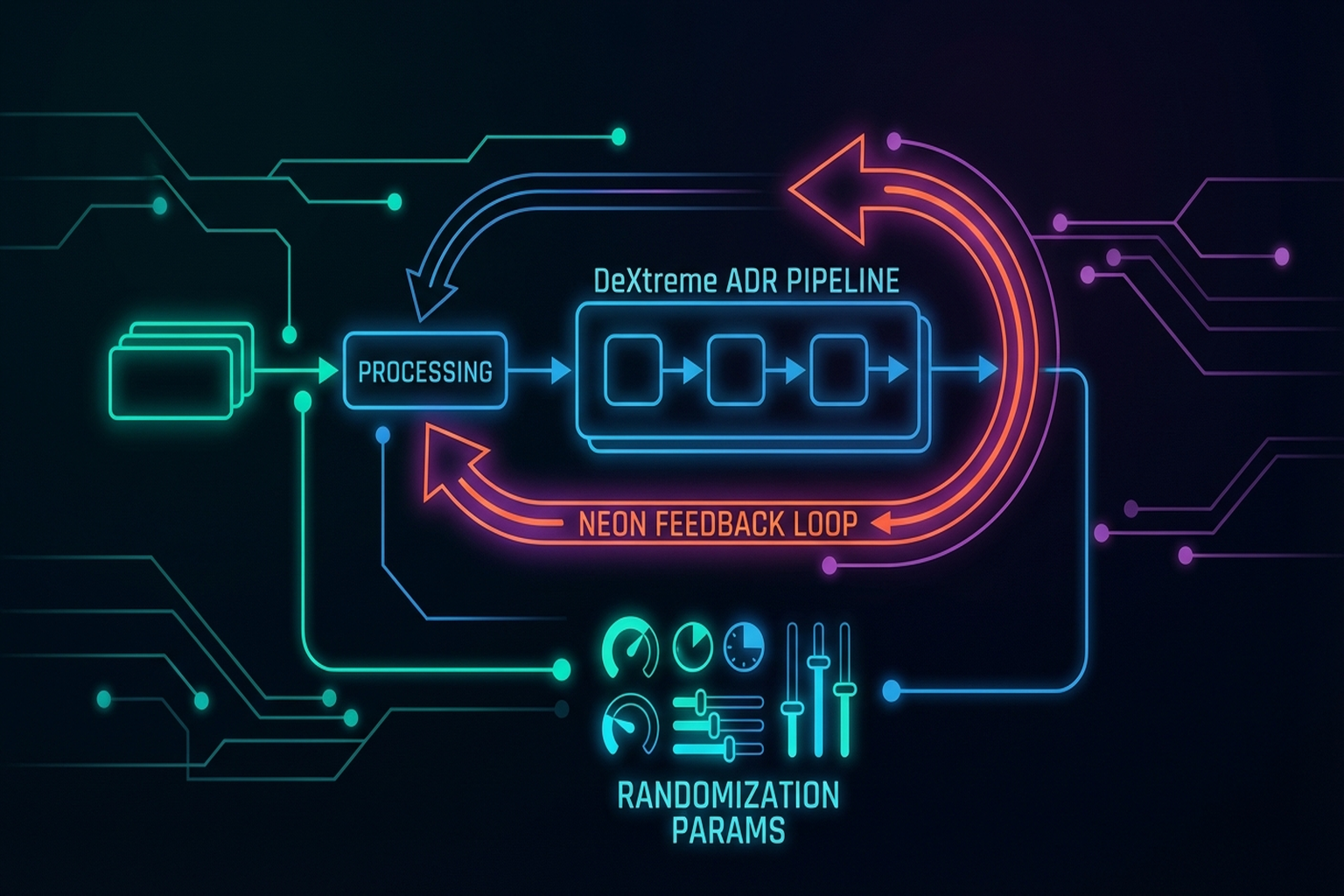

Handa et al. [2023, NVIDIA]의 DeXtreme은 DR의 최선 사례입니다:

- 자동 도메인 랜덤화(ADR): 물리 + 비물리 파라미터 동시 랜덤화

- 물리: 마찰, 질량, 관절 강성, 중력

- 비물리: 조명, 카메라 위치, 텍스처, 배경

- Allegro Hand + Isaac Gym

- Omniverse Replicator로 합성 시각 데이터 생성

- 시각 기반 정책이 기존 문헌 능가

핵심 논문: Handa, A., et al. (2023). "DeXtreme: Transfer of Agile In-hand Manipulation from Simulation to Reality." ICRA 2023. Allegro Hand + Isaac Gym에서 ADR로 sim-to-real 다지 조작 달성. 물리/비물리 파라미터의 동시 랜덤화가 핵심입니다.

9.3 촉각 Sim-to-Real: 이진 촉각 피부 모델, 제로샷 전이

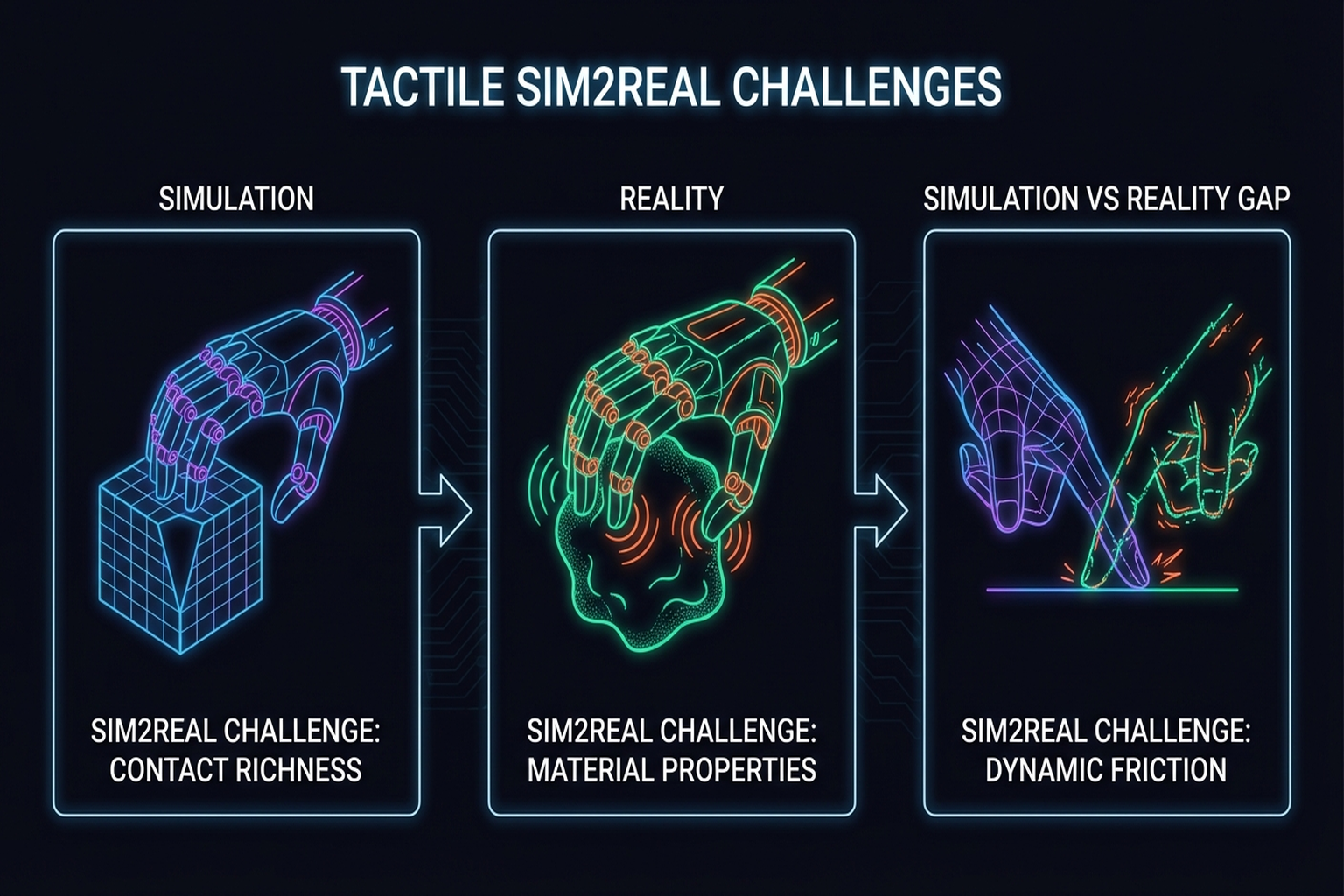

촉각 sim-to-real은 시각 sim-to-real보다 본질적으로 어렵습니다:

- 젤 변형의 정확한 모델링 어려움

- 다중 물리 결합 (광학 + 변형 + 접촉)

- 센서 노이즈 프로파일의 시뮬레이션/현실 차이

Yin et al.[4]의 이진 3축 촉각 피부(binary 3-axis tactile skin [#13]) 모델은 이 문제의 실용적 해법입니다:

- 단순화: 연속 힘 → 이진 접촉 (접촉 여부 + 3축 방향)

- 5,000 FPS 시뮬레이션 속도

- 제로샷 sim-to-real 전이 성공

- OOD 물체에서 93% 성공률

이 연구의 핵심 교훈: 정밀한 촉각 시뮬레이션보다 단순화된 모델 + 넓은 커버리지가 sim-to-real 전이에 더 효과적일 수 있습니다.

Sim-to-Real RL for Humanoid Dexterous Manipulation[6]은 환경 모델링, 보상 설계, 정책 학습, 전이의 실용적 레시피를 제공합니다.

9.4 Real-Sim-Real: RoboPaint [#15], X-Sim, ExoStart

Real-Sim-Real은 실제 데이터를 시뮬레이션에 통합한 후 다시 현실로 전이하는 루프입니다.

RoboPaint (2025)

3D Gaussian Splatting(3DGS)으로 실제 장면을 시뮬레이션에 재구성하여, 시뮬레이션의 시각적 충실도를 높입니다. 이는 시각적 sim-to-real 격차를 줄이는 데 기여합니다.

X-Sim (2025)

Dan et al.[6]의 X-Sim은 Real-to-Sim-to-Real 파이프라인입니다:

- 실제 인간 데이터를 시뮬레이션으로 전이

- 시뮬레이션에서 정책 학습

- 학습된 정책을 다시 현실로 전이

- 세미나 1에서 핵심 사례로 논의

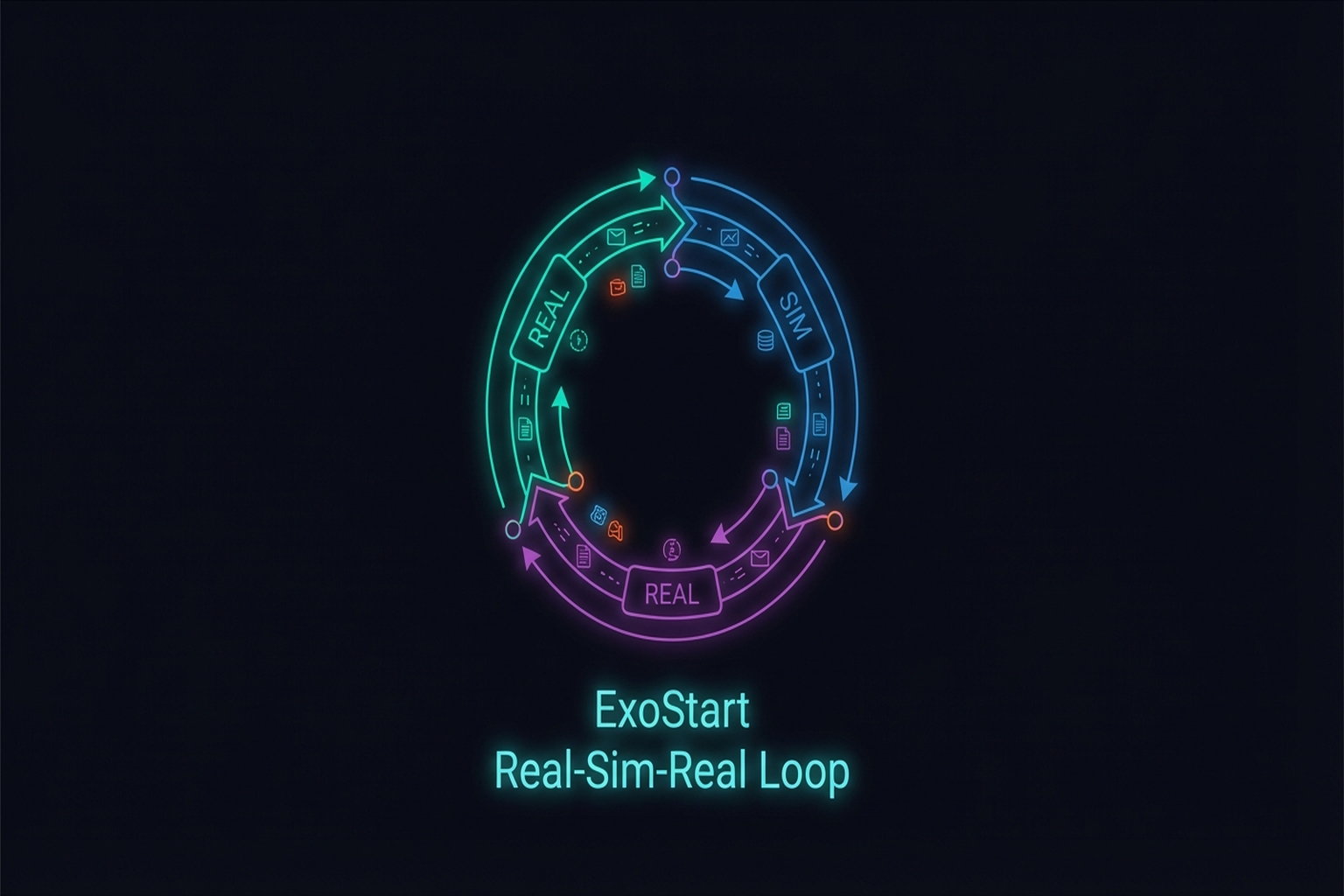

ExoStart (2025)

Si et al.[6]의 ExoStart는 Real-Sim-Real의 가장 데이터 효율적인 사례입니다:

- ~10회 외골격 시연 (현실)

- MuJoCo dynamics filtering (시뮬레이션)

- Auto-curriculum RL (시뮬레이션)

- ACT vision student (증류)

- 제로샷 현실 전이

7개 태스크 중 6개에서 >50% 성공률을 달성합니다.

핵심 논문: Si, Z., et al. (2025). "ExoStart: From 10 Exoskeleton Demos to Dexterous Robot Manipulation." Various. 10회 외골격 시연 → MuJoCo dynamics filtering → auto-curriculum RL → zero-shot real 전이. 데이터 효율적 Real-Sim-Real의 대표 사례.

DexWM (2025)

Meta FAIR의 DexWM [arXiv Dec 2025]은 인간 비디오로부터 world model을 학습하는 접근입니다:

- 829시간의 인간 비디오 + 로봇 데이터를 결합하여 world model 학습

- 학습된 world model로 정책을 시뮬레이션 없이 직접 학습

- 83% real grasping 성공률 (zero-shot)

- 기존 Real-Sim-Real과 달리, 명시적 시뮬레이션 엔진 없이 데이터에서 직접 dynamics를 학습

- Chapter 10.6의 co-training 접근과 Chapter 10.7의 teleop-free 접근의 중간에 위치하는 방법론

9.5 Sim-to-Real 격차 분석: 동역학, 인지, 접촉 모델

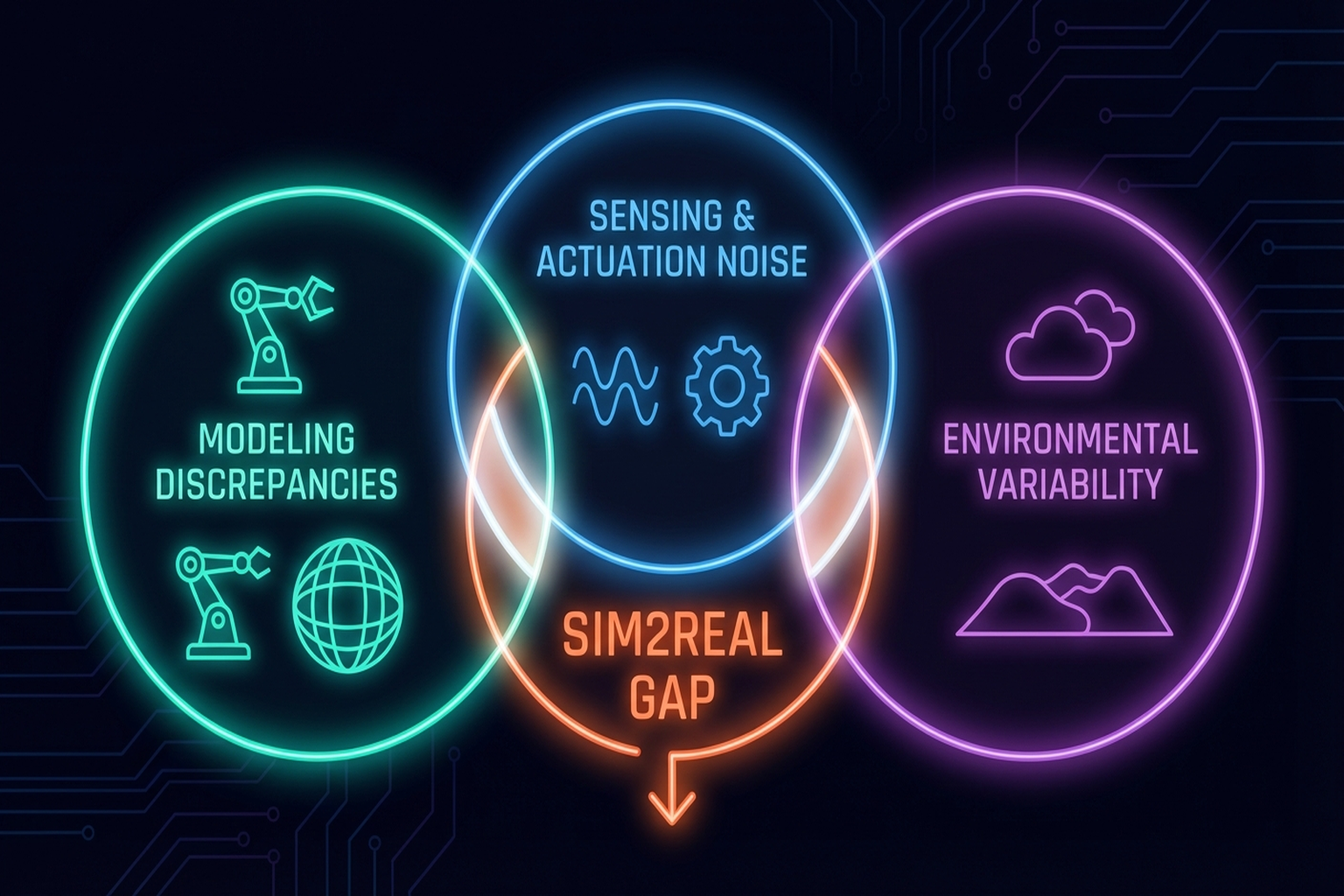

Sim-to-real 격차의 세 가지 근원:

9.5.1 동역학 격차 (Dynamics Gap)

관절 마찰(joint friction), 정마찰(stiction), 접촉 동역학, 변형 물질 거동의 충실한 모델링이 어렵습니다. DeXtreme의 ADR은 이 격차를 "강건성(robustness)"으로 극복하지만, 모든 격차를 해소할 수는 없습니다.

9.5.2 인지 격차 (Perception Gap)

카메라 이미지, 깊이 맵, 촉각 이미지의 시뮬레이션/현실 차이입니다. Omniverse Replicator의 합성 시각 데이터, RoboPaint의 3DGS 재구성이 이를 줄입니다.

9.5.3 접촉 모델 격차 (Contact Model Gap)

촉각 sim-to-real의 가장 어려운 부분입니다. FEM은 정밀하지만 계산 비용이 높고, 해석적 모델은 근사가 거칩니다. DiffTactile은 미분 가능한 접촉 모델로 이 격차를 줄이려 하지만, 실시간 시뮬레이션에는 아직 부족합니다.

Human-in-the-Loop RL [2025, Science Robotics]는 인간 직관과 자율 정책 최적화를 결합하여, sim-to-real 격차가 클 때에도 정밀 조작을 달성합니다.

9.6 합성 데이터의 위력과 한계

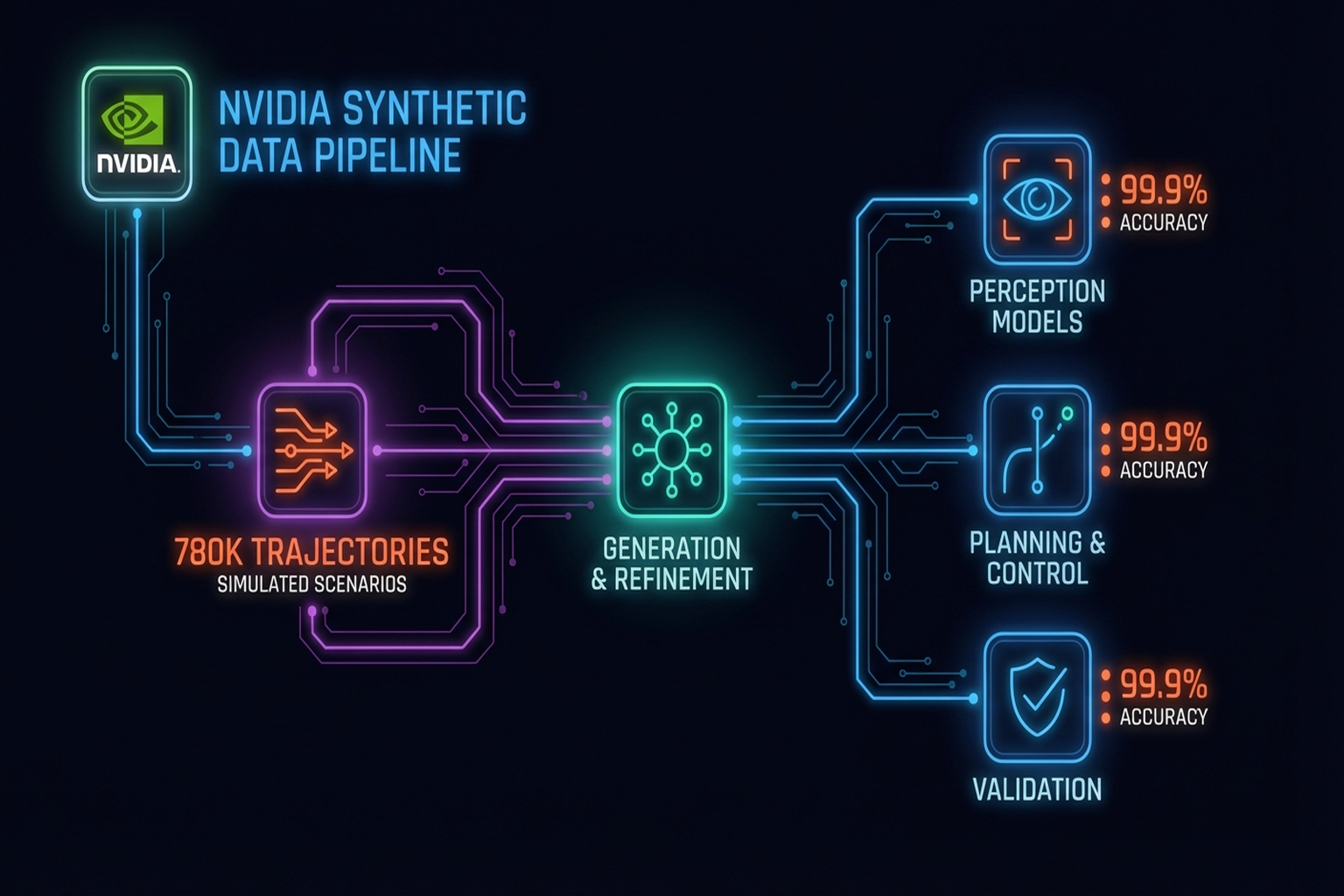

NVIDIA의 합성 데이터 파이프라인은 현재 가장 강력한 데이터 생성 접근입니다:

- 780K 궤적 (6,500시간 상당) → 11시간에 생성

- 실제 성능 40% 향상

- Isaac Sim + Omniverse Replicator

그러나 합성 데이터의 한계도 명확합니다:

- Sim-to-real 격차가 합성 데이터의 효과를 제한

- 촉각 합성 데이터는 시각보다 격차가 크다

- 물성(material property) 다양성의 시뮬레이션이 어려움

요약 및 전망

Sim-to-real 전이는 촉각 기반 조작의 가장 큰 병목 중 하나이며, 동시에 가장 빠르게 진보하는 영역입니다. DeXtreme의 ADR, Yin et al.의 단순화된 촉각 모델, ExoStart의 데이터 효율적 Real-Sim-Real이 현재의 최전선입니다. NVIDIA의 합성 데이터 파이프라인은 규모 문제를 해결하지만, 촉각 sim-to-real 격차는 시각보다 근본적으로 크며, DiffTactile/TacEx 방향의 발전이 필요합니다.

다음 챕터에서는 인간에서 로봇으로의 Embodiment Retargeting을 다룹니다 (→ Chapter 10 참조).

참고문헌

- Handa, A., et al. (2023). DeXtreme: Transfer of agile in-hand manipulation from simulation to reality. ICRA 2023. arXiv:2210.13702. scholar

- Various. (2020). OpenAI Dactyl: Solving Rubik's Cube with a robot hand. IJRR. scholar

- Wang, S., Lambeta, M., et al. (2022). Tacto: A fast, flexible, and open-source simulator for vision-based tactile sensors. IEEE RA-L. scholar

- Si, Z., Zhang, G., Ben, Q., Romero, B., Xian, Z., Liu, C., & Gan, C. (2024). DiffTactile: A physics-based differentiable tactile simulator for contact-rich robotic manipulation. ICLR 2024. arXiv:2403.08716. scholar

- Yin, Z.-H., et al. (2024). Learning in-hand translation using a binary 3-axis tactile skin. arXiv preprint. #13 scholar

- Si, Z., Qian, K., Sontakke, N., et al. (2025). ExoStart: Efficient learning for dexterous manipulation with sensorized exoskeleton demonstrations. arXiv preprint. arXiv:2506.11775. #9 scholar

- Dan, P., et al. (2025). X-Sim: Cross-embodiment learning via real-to-sim-to-real. arXiv preprint. scholar

- Various. (2026). RoboPaint: From human demonstration to any robot and any view. arXiv preprint. #15 scholar

- Various. (2024). TacEx: GelSight tactile simulation in Isaac Sim. arXiv preprint. arXiv:2411.04776. scholar

- Various. (2025). Sim-to-real reinforcement learning for vision-based dexterous manipulation on humanoids. arXiv preprint. arXiv:2502.20396. scholar

- Various. (2025). Human-in-the-loop RL for precise dexterous manipulation. Science Robotics. https://doi.org/10.1126/scirobotics.ads5033. scholar

- NVIDIA. (2025). GR00T N1: An open foundation model for generalist humanoid robots. arXiv preprint. arXiv:2503.14734. scholar

- NVIDIA. (2026). Synthetic data pipeline: 780K trajectories in 11 hours. GTC 2026 Keynote. scholar

- Various. (2025). Tactile Robotics: Past and Future. arXiv:2512.01106. scholar

- Lipman, Y., et al. (2023). Flow matching for generative modeling. ICLR 2023. scholar

- Various. (2025). DexWM: Dexterous world models from human video. arXiv preprint. Meta FAIR. scholar