Chapter 11: 시스템 통합 — 연구적 관점

개요

앞선 10개 챕터에서 개별 구성 요소 — 센서, 데이터, 핸드, 학습, 전이 — 를 다뤘다면, 이 챕터에서는 이들이 하나의 시스템으로 통합되는 과정을 다룹니다. 다중 모달 융합 아키텍처, End-to-End 시스템 사례, 오픈소스 생태계, 벤치마크와 표준화를 통해 연구의 현 위치를 조망합니다.

이 챕터를 읽고 나면... - 시각-촉각 융합의 주요 아키텍처(early/late/MoE)를 비교할 수 있습니다. - Mobile ALOHA, PP-Tac [#12], 세미나 3 통합 그리퍼의 시스템적 의의를 설명할 수 있습니다. - 오픈소스 하드웨어/소프트웨어/데이터의 연구 가속화 효과를 이해합니다. - RGMC 등 벤치마크의 현황과 표준화 필요성을 파악합니다.

11.1 다중 모달 통합 아키텍처

시각-촉각 융합

Robot Synesthesia [1]: 포인트 클라우드 기반 촉각과 시각의 융합. PointNet 인코더로 촉각 포인트 클라우드 처리, 새로운 물체에 일반화 (→ Chapter 3.1.4).

NeuralFeels [2]: 신경장(neural field) 기반 시각-촉각 인지. 손 안에서 물체의 자세와 형상을 동시에 추정. Science Robotics (→ Chapter 1.3.4).

3D-ViTac [3]: 3mm² 밀도 촉각 + 시각의 통합 3D 표현. Diffusion Policy로 85-90% 양손 성공률 (시각만 45-50%) (→ Chapter 2.4).

힘-시각-언어 융합

ForceVLA [12] [#1]: FVLMoE(4 expert MoE)로 힘-시각-언어 동적 라우팅. +23.2%p, 시각 가림 시 90% (→ Chapter 7.4, 8.4).

Tactile-VLA[5]: VLA의 사전학습 물리 지식을 촉각으로 해방 (→ Chapter 8.4).

표현 정렬

UniTouch [6]: 대조 학습으로 촉각-시각-언어-오디오 정렬. 제로샷 분류 (→ Chapter 3.6).

Sparsh [7]: 460K+ 이미지 자기지도 촉각 Foundation Model (→ Chapter 3.6).

VTV-LLM[8]: 접촉 전 물리 속성(마찰, 유연성) 추론. 시각-촉각 비디오 + LLM으로 물성 예측.

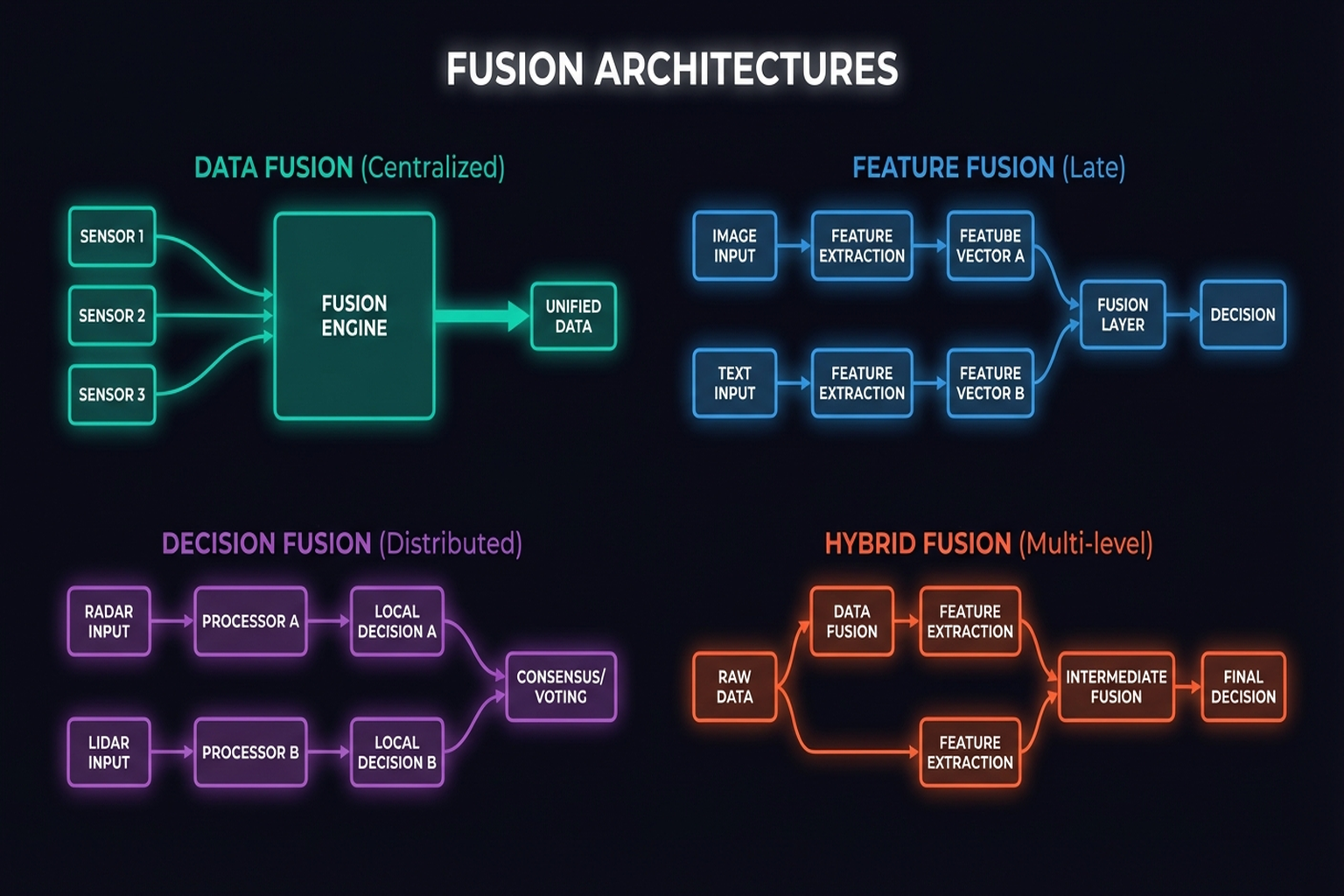

융합 아키텍처 비교

| 아키텍처 | 장점 | 단점 | 대표 사례 |

|---|---|---|---|

| Early fusion | 저수준 특징 결합 | 모달리티 간 간섭 | 3D-ViTac |

| Late fusion | 모달리티 독립 학습 | 교차 모달 상호작용 제한 | NeuralFeels |

| MoE (동적 라우팅) | 태스크별 최적 융합 | 학습 복잡도 | ForceVLA |

| Attention 기반 | 유연한 가중치 | 계산 비용 | Transformer 기반 VLA |

11.2 End-to-End 시스템 사례

Mobile ALOHA (2024)

Fu, Zhao, Finn [2024, Stanford]: 저비용 이동 양손 조작 시스템:

- ACT 기반 정책 학습

- 모바일 베이스 + 양손 조작 통합

- ~200회 인용

- 연구에서 가장 영향력 있는 end-to-end 시스템

TacEx (2024)

Isaac Sim에서 GelSight 시뮬레이션을 통합:

- 센서 시뮬레이션 → 정책 학습 → sim-to-real 전이를 하나의 플랫폼에서

- 연구 워크플로우 통합의 모범 사례

PP-Tac (2025)

R-Tac + 미끄러짐 감지 + Diffusion Policy → 87.5% 얇은 물체 파지:

- 센서(R-Tac) + 인지(slip CNN) + 제어(force control) + 학습(Diffusion Policy) 통합

- 실용적 문제 해결 지향 시스템

세미나 3 통합 그리퍼

Underactuation + VSA + Active Belt → 공장 자동화 end-effector:

- 메커니즘(Chapter 5) + 센싱 + 제어의 물리적 통합

- 얇은 물체, 복수 물체, 재배치를 하나의 그리퍼로

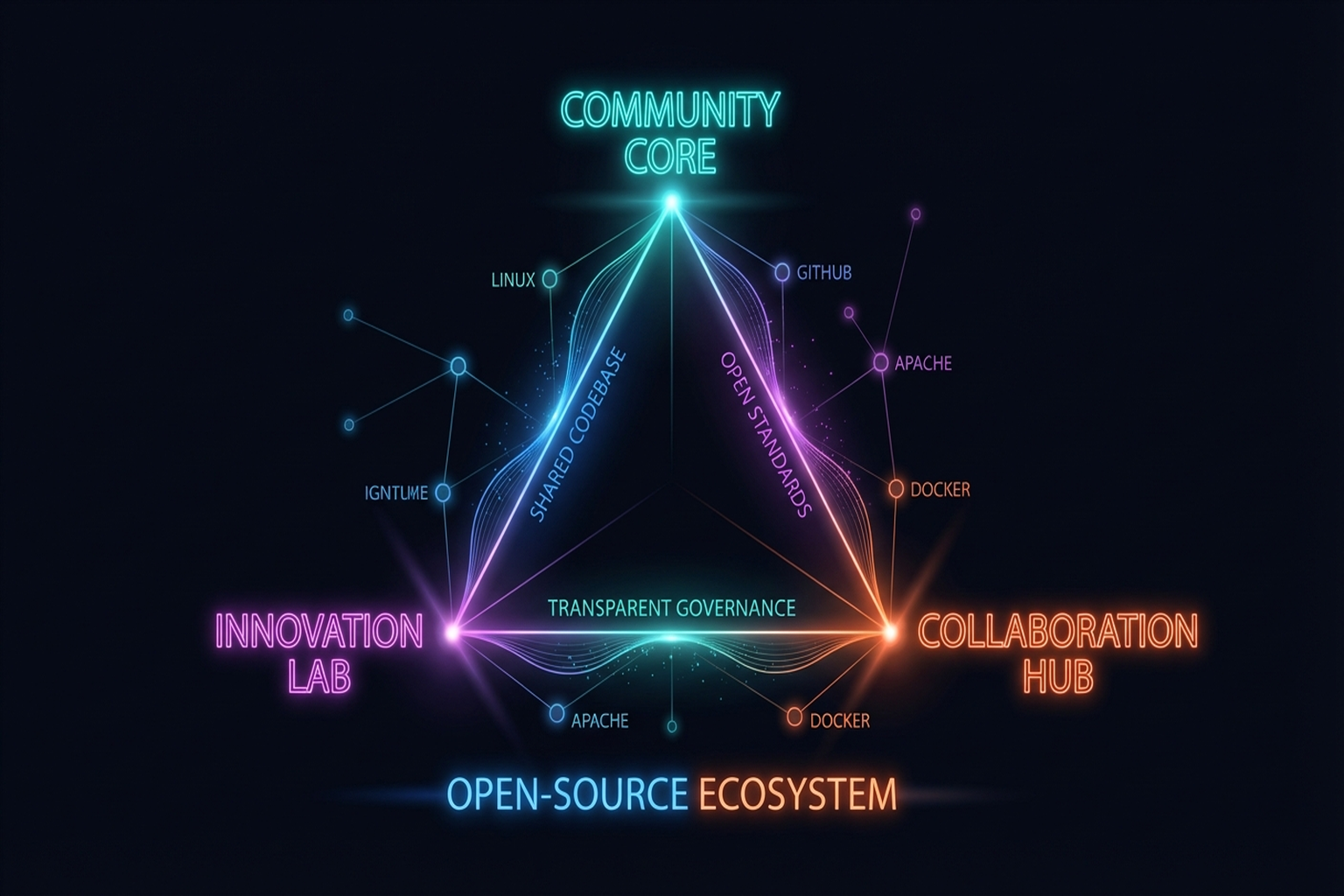

11.3 오픈소스 생태계와 연구 가속화

촉각 로봇 연구의 가속화는 오픈소스 생태계에 크게 의존합니다.

하드웨어 오픈소스

- LEAP Hand ($2K): 3D 프린팅 다지 핸드

- ORCA (17-DoF): 건 구동 + 촉각 통합

- ISyHand ($1.3K): 관절 손바닥

- OSMO 글로브: 12개 3축 촉각 센서

소프트웨어 오픈소스

- OpenVLA: 7B VLA 모델 (가중치 + 코드)

- Octo: 범용 로봇 정책

- Diffusion Policy: 행동 확산 정책

- ACT/ALOHA: 행동 청킹

데이터 오픈소스

- Open X-Embodiment: 1M+ 궤적, 22 체현

- Touch-and-Go: 3M+ 촉각 접촉

- Touch100k: 100K+ 촉각 이미지

- VTDexManip: 10 태스크, 182 물체

오픈소스가 재현성(reproducibility)과 연구 속도에 미친 영향은 혁명적입니다. 2023년 이전에는 다지 조작 연구에 $16K-100K의 하드웨어가 필요했지만, 현재는 $2K로 시작할 수 있습니다.

11.4 벤치마크와 표준화 동향

RGMC (Robotic Grasping and Manipulation Competition)

ICRA에서 매년 개최되는 RGMC는 촉각 조작의 가장 공인된 벤치마크입니다. 2025년 RGMC Champion [12]은 학습 없는 최적화 접근으로 우승하여, 방법론적 다양성의 중요성을 보여주었습니다 (→ Chapter 7.5).

촉각 센서 벤치마크의 부재

시각 인지(perception)에는 ImageNet, COCO 등 표준 벤치마크가 존재하지만, 촉각 센서에는 공인 벤치마크가 없습니다. 이는 센서 간 성능 비교를 어렵게 하며, 연구 재현성을 저해합니다.

데이터 포맷 표준화

Albini et al.[12]의 6가지 데이터 구조(Chapter 3)가 de facto 표준 후보입니다. 촉각 데이터의 표준 포맷이 확립되면, 교차 센서/교차 연구실 데이터 공유가 가능해집니다.

교차 체현 평가 프레임워크

Open X-Embodiment[14]가 제시한 교차 체현 평가 프레임워크는 다양한 로봇에서의 일관된 성능 비교를 가능하게 합니다.

Multimodal Tactile-Vision for Housekeeping [Nature Communications, 2024]은 가사 환경에서 압력, 온도, 질감, 미끄러짐 + 시각의 다중 모달 통합을 구현한 end-to-end 사례입니다.

요약 및 전망

시스템 통합은 개별 구성 요소의 발전만큼이나 중요합니다. ForceVLA의 MoE 융합, Mobile ALOHA의 저비용 양손 시스템, PP-Tac의 실용적 문제 해결, 그리고 세미나 3의 메커니즘 통합이 각각 다른 관점에서 "전체는 부분의 합보다 크다"를 보여줍니다. 오픈소스 생태계는 이 통합을 가속화하는 핵심 동력이며, 표준화된 벤치마크의 확립이 다음 단계의 과제입니다.

다음 챕터에서는 이 연구적 성과가 산업으로 전환되는 Physical AI와 산업 전망을 다룹니다 (→ Chapter 12 참조).

참고문헌

- Yuan, Y., et al. (2024). Robot Synesthesia: In-hand manipulation with visuotactile sensing. ICRA 2024. scholar

- Suresh, S., et al. (2024). NeuralFeels: Neural fields for visuotactile perception. Science Robotics, 9(86). scholar

- Huang, B., et al. (2024). 3D-ViTac: Learning fine-grained manipulation with visuo-tactile sensing. CoRL 2024. scholar

- Yu, J., Liu, H., Yu, Q., Ren, J., Hao, C., Ding, H., Huang, G., Huang, G., Song, Y., Cai, P., Lu, C., & Zhang, W. (2025). ForceVLA: Enhancing VLA models with a force-aware MoE for contact-rich manipulation. NeurIPS 2025. arXiv:2505.22159. #1 scholar

- Huang, J., Wang, S., Lin, F., Hu, Y., Wen, C., & Gao, Y. (2025). Tactile-VLA: Unlocking vision-language-action model's physical knowledge for tactile generalization. OpenReview. scholar

- Yang, F., et al. (2024). UniTouch: Binding touch to everything. CVPR 2024. scholar

- Higuera, C., et al. (2024). Sparsh: Self-supervised touch representations. CoRL 2024. scholar

- Liu, K., et al. (2025). VTV-LLM: Robotic perception with a large tactile-vision-language model. arXiv preprint. arXiv:2506.19303. scholar

- Fu, Z., Zhao, T. Z., & Finn, C. (2024). Mobile ALOHA: Learning bimanual mobile manipulation with low-cost whole-body teleoperation. arXiv preprint. arXiv:2401.02117. scholar

- Various. (2024). TacEx: GelSight tactile simulation in Isaac Sim. arXiv preprint. arXiv:2411.04776. scholar

- Lin, P., Huang, Y., Li, W., Ma, J., Xiao, C., & Jiao, Z. (2025). PP-Tac: Paper picking using omnidirectional tactile feedback in dexterous robotic hands. RSS 2025. #12 scholar

- Yu, M., et al. (2025). RGMC Champion: Kinematic trajectory optimization. IEEE RA-L. scholar

- Albini, A., et al. (2025). Representing data in robotic tactile perception. arXiv (IEEE T-RO). scholar

- Open X-Embodiment Collaboration. (2024). Open X-Embodiment. ICRA 2024. scholar

- Mao, Q., Liao, Z., Yuan, J., & Zhu, R. (2024). Multimodal tactile sensing fused with vision for dexterous robotic housekeeping. Nature Communications, 15, 6871. https://doi.org/10.1038/s41467-024-51261-5 scholar

- Various. (2025). Simultaneous tactile-visual perception for learning multimodal robot manipulation. arXiv preprint. arXiv:2512.09851. scholar

- Various. (2025). Multimodal fusion and vision-language models: A survey for robot vision. Information Fusion (Elsevier). arXiv:2504.02477. scholar

- Various. (2025). Tactile Robotics: An outlook. arXiv preprint. arXiv:2508.11261. scholar