Chapter 1: 왜 촉각인가 — 로봇에게 손의 감각을

개요

인간은 시각이 차단된 상태에서도 주머니 속 열쇠를 찾고, 종이 한 장을 집어 넘기며, 달걀을 깨뜨리지 않고 옮길 수 있습니다. 이 모든 행위의 밑바탕에는 촉각(tactile sensing)이라는 감각이 작동합니다. 그러나 오늘날 대부분의 로봇은 이 감각 없이 세상을 조작하고 있습니다. 이 챕터에서는 촉각이 로봇 조작(manipulation)에서 왜 필수적인지를 생물학적, 공학적, 산업적 관점에서 살펴보고, 이 책 전체의 로드맵을 제시합니다.

이 챕터를 읽고 나면... - 생물학적 촉각의 작동 원리와 로봇 촉각의 차이를 이해할 수 있습니다. - 촉각 없이 실패하는 구체적 사례들을 설명할 수 있습니다. - 촉각 로봇 공학의 역사적 흐름을 조망할 수 있습니다. - 이 책의 구성과 각 파트의 관계를 파악할 수 있습니다.

1.1 생물학적 촉각의 원리

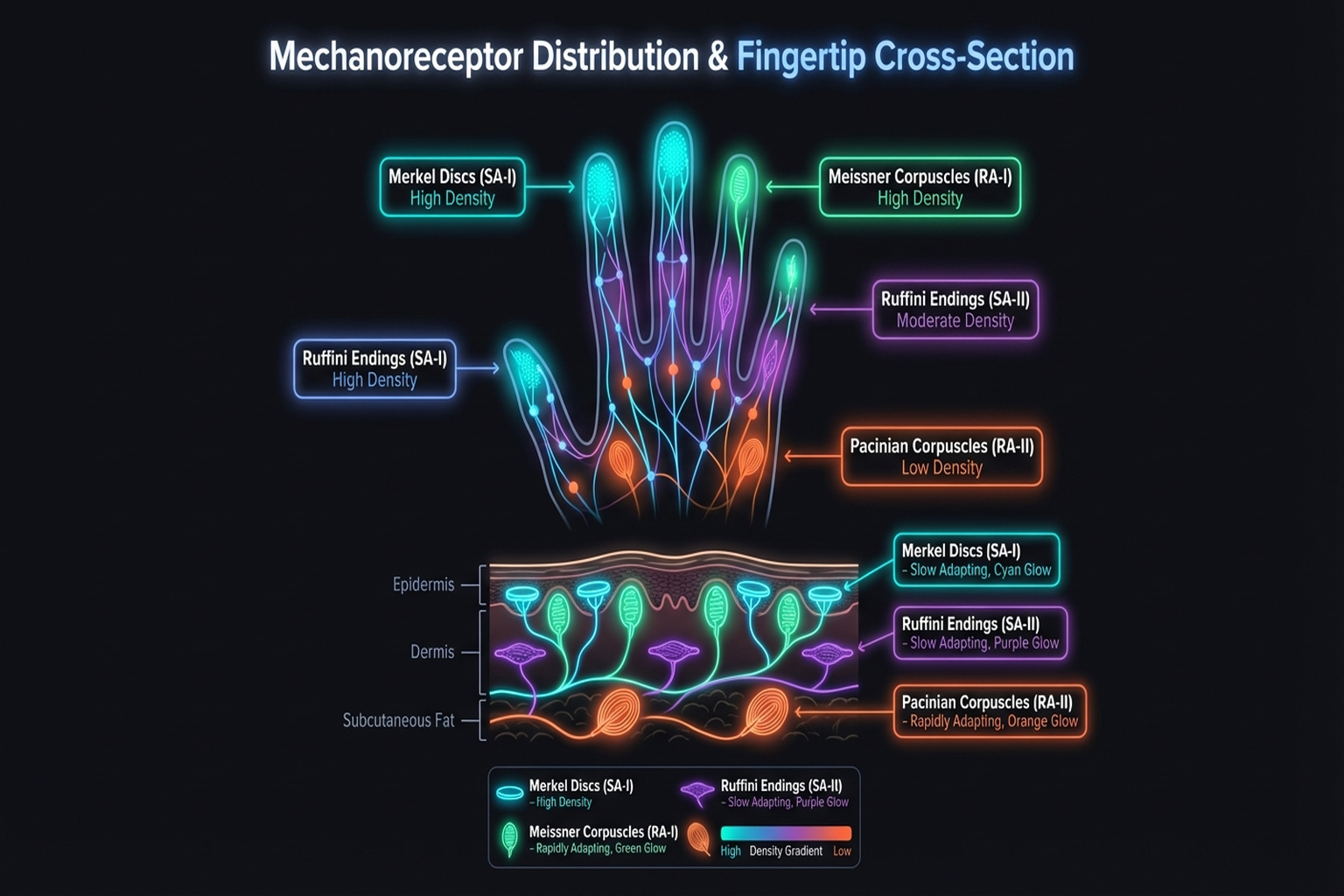

인간의 손은 약 17,000개의 기계적 수용기(mechanoreceptor)를 갖추고 있으며, 이들은 접촉, 압력, 진동, 온도 변화를 감지합니다 [1]. 손끝(fingertip)의 수용기 밀도는 약 240개/cm²에 달하여, 13μm 수준의 미세한 표면 구조까지 구별할 수 있습니다 [2].

생물학적 촉각 시스템의 핵심 특성은 다음과 같습니다:

| 수용기 유형 | 감지 대상 | 적응 속도 | 로봇 대응 센서 |

|---|---|---|---|

| Merkel 디스크 | 압력, 형상 | 느림 (SA I) | 압저항식(piezoresistive) |

| Meissner 소체 | 가벼운 접촉, 미끄러짐 | 빠름 (RA I) | 정전용량식(capacitive) |

| Ruffini 종말 | 피부 신장 | 느림 (SA II) | 스트레인 게이지(strain gauge) |

| Pacinian 소체 | 진동 (40-400Hz) | 빠름 (RA II) | 압전식(piezoelectric) |

핵심 논문: Johansson, R. S. & Flanagan, J. R. (2009). "Coding and Use of Tactile Signals from the Fingertips in Object Manipulation Tasks." Nature Reviews Neuroscience, 10, 345-359. 인간이 물체를 조작할 때 손끝의 촉각 신호가 어떻게 부호화(encoding)되고 활용되는지를 체계적으로 밝힌 신경과학 기초 연구입니다.

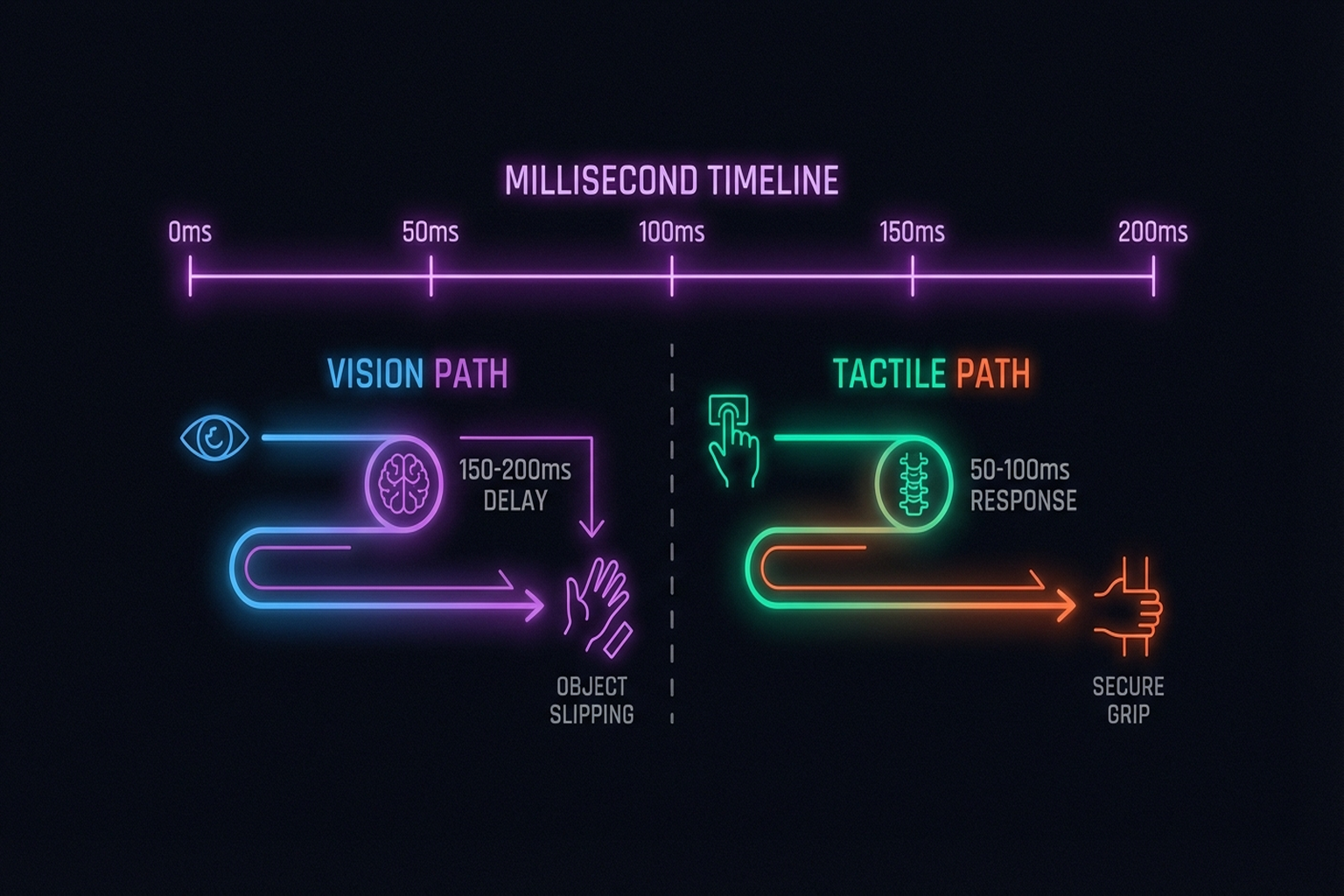

인간은 물체를 잡을 때 접촉 후 약 100ms 이내에 미끄러짐(slip)을 감지하고 힘을 조절합니다. 이 피드백 루프가 없다면, 우리는 종이컵을 찌그러뜨리거나 달걀을 떨어뜨릴 것입니다. 마찬가지로, 로봇이 접촉이 풍부한(contact-rich) 환경에서 안전하고 능숙하게 물체를 다루려면 촉각 피드백이 필수적입니다.

1.2 촉각 로봇 공학의 역사와 발전

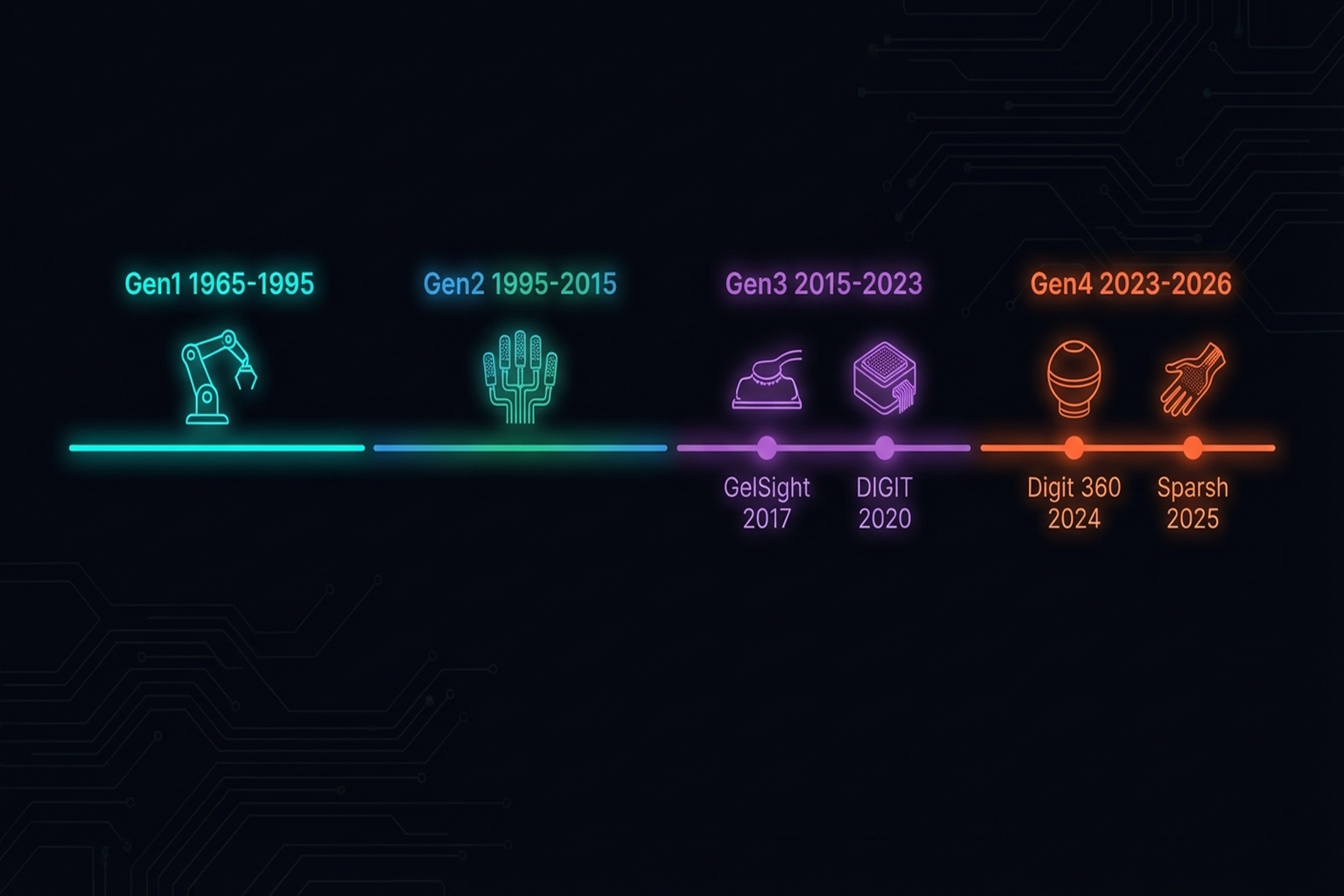

촉각 로봇 공학의 역사는 1960년대로 거슬러 올라갑니다. "Tactile Robotics: Past and Future" [2025] 서베이는 이 역사를 네 세대로 구분합니다:

1세대 — 기원 (1965-1980년대): 초기 촉각 센서는 단순한 접촉 감지(binary contact detection)에 그쳤습니다. 힘-토크(force-torque) 센서가 산업용 로봇 팔에 도입되기 시작했지만, 손가락 수준의 촉각은 먼 목표였습니다.

2세대 — 성장 (1980-2000년대): Dahiya et al. [3]의 기념비적 서베이가 정리한 바와 같이, 이 시기에 압저항식, 정전용량식, 압전식 등 다양한 변환(transduction) 방식이 탐구되었습니다. Shadow Hand(1990s)와 같은 다지 핸드(dexterous hand) 프로토타입이 등장했지만, 센서의 내구성과 비용이 실용화의 벽이었습니다.

핵심 논문: Dahiya, R. S., Metta, G., Valle, M., & Sandini, G. (2010). "Tactile Sensing: From Humans to Humanoids." IEEE Transactions on Robotics, 26(1), 1-20. 촉각 센싱의 변환 방법, 데이터 처리, 시스템 통합을 망라한 기초 서베이로, 촉각 로봇 연구의 사실상 표준 출발점입니다.

3세대 — 촉각의 겨울 (2000-2015년): 컴퓨터 비전의 비약적 발전(deep learning, CNNs)으로 연구 커뮤니티의 관심이 시각 기반 로봇 공학으로 집중되면서, 촉각 연구는 상대적으로 정체기를 겪었습니다. 그러나 이 시기에도 BioTac($5K-10K)과 같은 고성능 촉각 센서가 개발되어 꾸준한 기초 연구가 이어졌습니다.

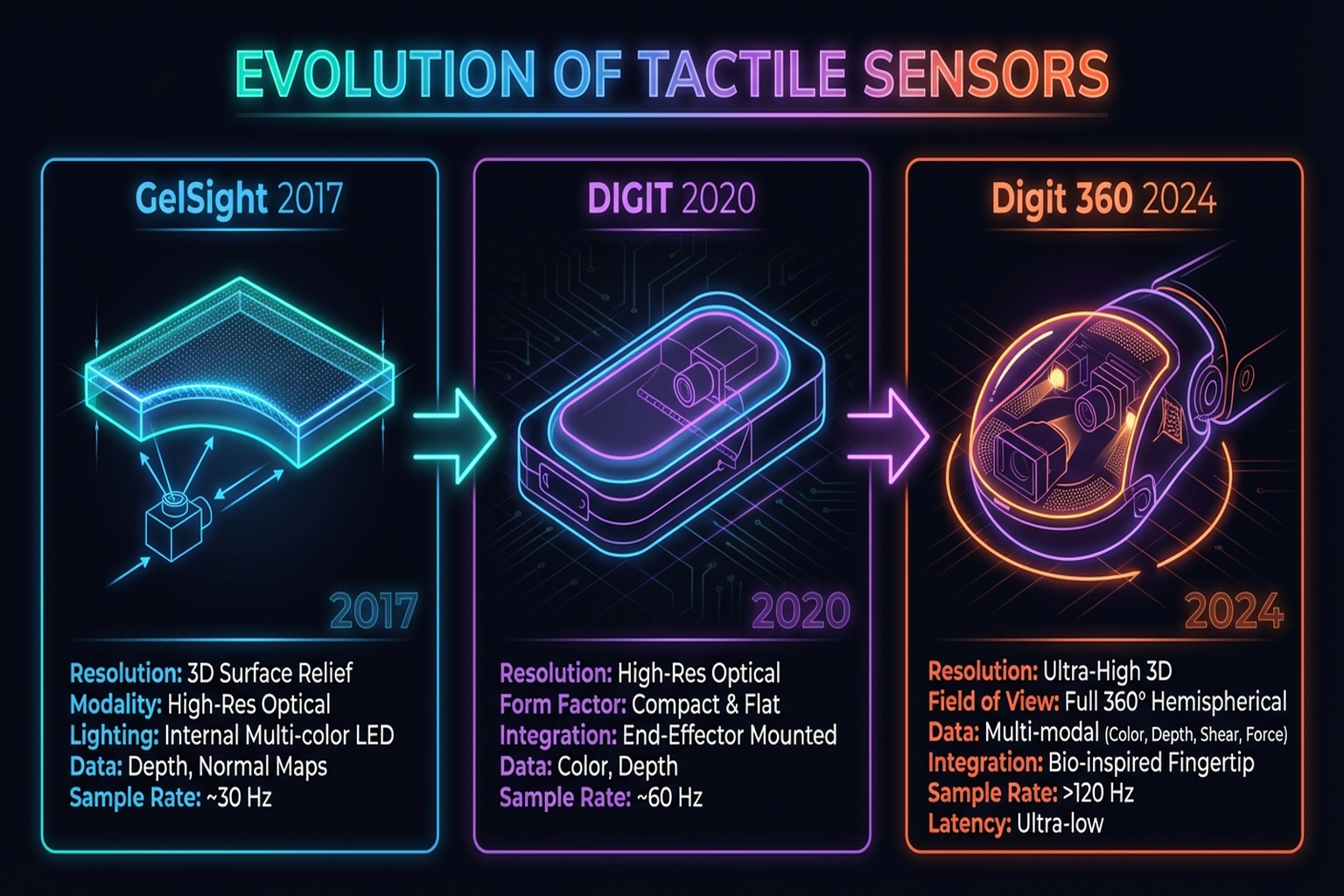

4세대 — 부활 (2015-현재): GelSight [4]의 등장이 전환점이 되었습니다. 비전 기반 광학 촉각 센서(vision-based optical tactile sensor)는 기존 센서 대비 월등한 해상도를 낮은 비용($350 수준의 DIGIT [5])으로 제공했습니다. 2024년에는 Digit 360이 8.3M taxel과 18가지 이상의 센싱 모달리티를 갖춘 다중 모달 인공 손가락을 선보이며 [6], 촉각 센서의 "ImageNet 모멘트"가 도래했다는 평가가 나오고 있습니다.

이 부활을 가속화한 또 다른 동력은 저비용 로봇 핸드의 민주화입니다. LEAP Hand [7]는 $2,000에 3D 프린팅으로 제작 가능한 인간형 핸드를 공개하여, $16,000의 Allegro Hand나 $100,000 이상의 Shadow Hand 없이도 다지 조작 연구를 수행할 수 있게 했습니다 (→ Chapter 4 참조).

1.3 촉각 없이 실패하는 사례

시각(vision)만으로는 해결이 어려운 조작 시나리오가 다수 존재합니다. 아래는 촉각의 부재가 직접적인 실패 원인이 되는 대표적 사례들입니다.

1.3.1 파지 실패 (Grasp Failure)

로봇이 물체를 잡을 때, 시각 정보만으로는 적절한 힘(gripping force)을 결정하기 어렵습니다. 같은 크기의 스티로폼 컵과 세라믹 머그컵은 카메라에 유사하게 보이지만, 필요한 파지력은 수십 배 차이가 납니다. F-TAC Hand[16]는 17개의 촉각 센서로 손 표면의 70%를 커버하여 다중 물체 파지에서 100% 성공률을 달성했습니다 — 이는 촉각 피드백의 위력을 직접 보여줍니다 (→ Chapter 2.4 참조).

1.3.2 미끄러짐 감지 (Slip Detection)

물체가 손에서 미끄러지는 것을 감지하려면 접선 방향(shear) 힘의 변화를 실시간으로 모니터링해야 합니다. Universal Slip Detection[17]은 97% 정확도와 1.26ms 지연 시간으로 미끄러짐을 감지하는 촉각 기반 시스템을 구현했습니다. 카메라로는 미끄러짐이 발생한 이후에야 이를 관찰할 수 있지만, 촉각은 미끄러짐이 시작되는 순간 감지할 수 있습니다.

1.3.3 변형 가능 물체 (Deformable Objects)

천, 케이블, 식품과 같은 변형 가능 물체(deformable object)의 조작은 시각만으로는 본질적으로 어렵습니다. 물체의 강성(stiffness), 마찰 계수, 현재 변형 상태를 추론하려면 접촉 정보가 필수적입니다. PP-Tac[18] [#12]은 R-Tac 촉각 센서와 미끄러짐 감지를 결합한 Diffusion Policy로 87.5%의 얇은 물체 파지 성공률을 달성했습니다 — 이는 종이, 카드 같은 극도로 얇은 물체에서의 성과입니다 (→ Chapter 7.3 참조).

1.3.4 가려진 상태 (Occlusion)

로봇이 물체를 손 안에서 회전(in-hand rotation)시킬 때, 손가락이 물체의 대부분을 가립니다. NeuralFeels [12]는 촉각과 시각을 결합한 신경장(neural field) 기반 SLAM으로 손 안에서 물체의 위치와 형상을 동시에 추정하는 In-hand SLAM을 구현했습니다 (Science Robotics, 2024). 시각만으로는 불가능한 과제입니다 (→ Chapter 11.1 참조).

1.4 촉각이 가능하게 하는 것

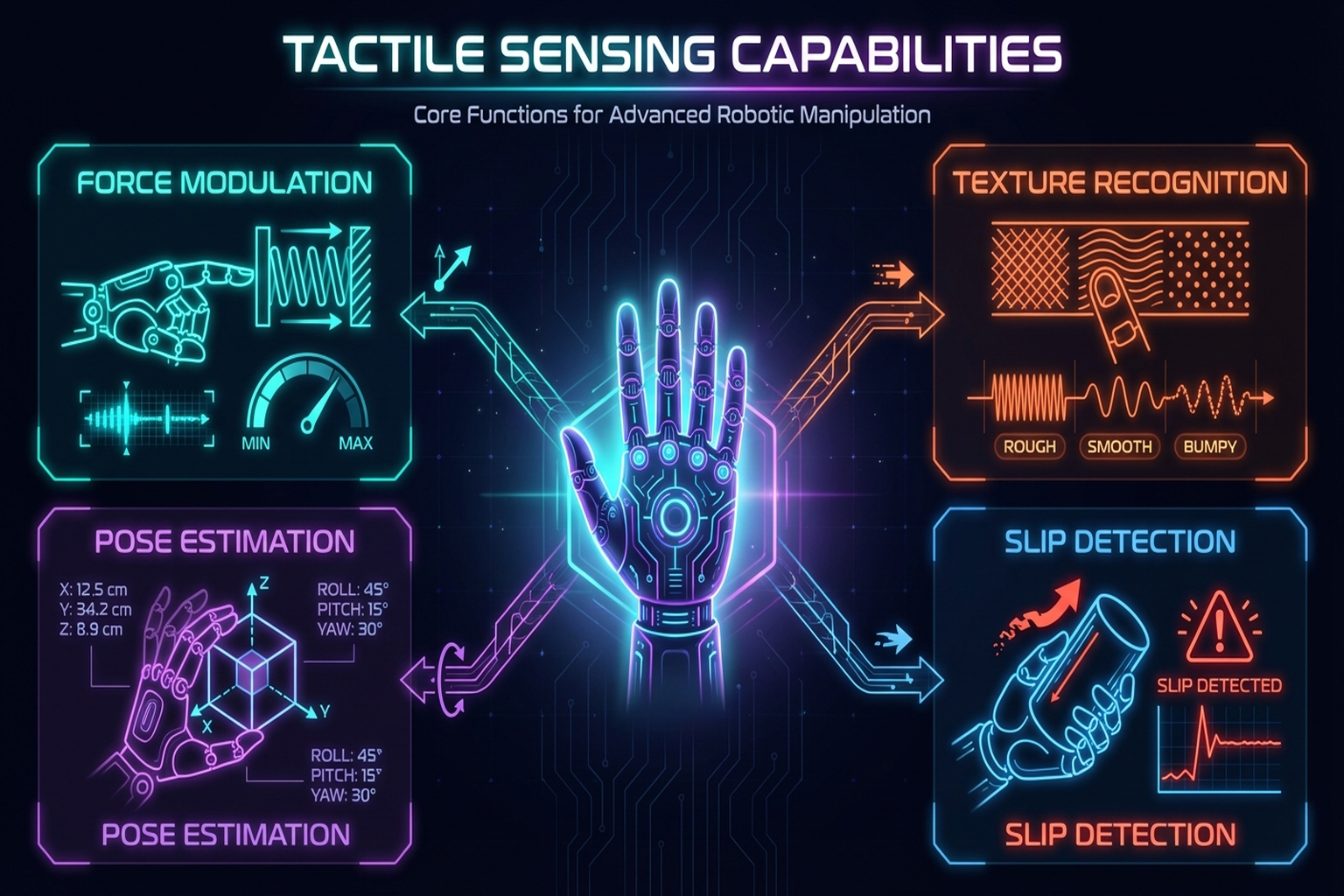

촉각 센싱은 로봇 조작에서 다음과 같은 핵심 능력을 제공합니다:

1.4.1 힘 조절 (Force Modulation)

촉각 피드백은 파지력의 실시간 조절을 가능하게 합니다. Hogan [8]이 제안한 임피던스 제어(impedance control)는 로봇이 환경과 상호작용할 때 힘과 위치의 관계를 조절하는 기초 이론을 제공했으며, 이는 오늘날 촉각 기반 힘 제어의 근간이 됩니다. DexForce[21] [#3]는 스프링 모델 기반의 운동학적 시연(kinesthetic teaching)으로 힘-토크 정보를 동시에 기록하고 학습하는 접근을 제시했습니다 (→ Chapter 7.4 참조).

1.4.2 미끄러짐 감지와 반응 (Slip Detection and Response)

전단력(shear force)의 변화를 감지하여 물체가 미끄러지기 전에 힘을 증가시킵니다. 다축 센싱(multi-axis sensing)의 중요성은 법선력(normal force)만으로는 전단 방향의 미끄러짐을 예측할 수 없다는 사실에서 비롯됩니다 [세미나 2, Taejoon]. Cho et al.[14]과 Hossain et al.[14]은 다차원 촉각 센싱이 미끄러짐 감지와 물체 방향 추정에서 단축 센서를 크게 능가함을 보였습니다.

1.4.3 자세 추정 (Pose Estimation)

접촉점의 분포와 힘 벡터로부터 손 안 물체의 위치와 자세를 추정합니다. 촉각 전용 손안 회전(tactile-only in-hand rotation) [10]은 시각 없이 이진 촉각(binary tactile) 센서만으로 물체를 연속적으로 회전시키는 것이 가능함을 입증했습니다 — 다만 세미나 1에서 논의된 바와 같이, 촉각만으로 가능한 조작은 현재 회전(rotation) 과제에 한정되며, 이는 촉각이 접촉 후의 국소(local) 정보만 제공하기 때문입니다.

1.4.4 질감 인식 (Texture Recognition)

표면의 미세 구조를 촉각으로 인식하는 것은 시각으로는 포착하기 어려운 물성(material property) 정보를 제공합니다. GelSight [4]는 광도 입체법(photometric stereo)으로 접촉면의 3D 구조를 마이크로미터 수준으로 복원하며, UniTouch [13]는 대조 학습(contrastive learning)으로 촉각을 시각, 언어, 오디오와 정렬하여 제로샷 질감 분류를 가능하게 했습니다 (→ Chapter 3.6 참조).

1.5 산업 및 일상 응용 전망

촉각 기반 로봇 조작은 연구실을 넘어 산업 현장으로 확장되고 있습니다. Markets and Markets는 휴머노이드 로봇 시장이 2025년 $29억에서 2030년 $153억으로 성장할 것으로 전망합니다 (CAGR 39.2%). Goldman Sachs는 2030년까지 250,000대 이상의 출하를, Morgan Stanley는 2050년까지 $5조 규모의 시장을 예측합니다.

1.5.1 제조업 — 최초의 교두보

현재 휴머노이드 로봇의 공장 배치는 자동차 산업이 선도하고 있습니다:

| 기업 | 고객 | 작업 | 상태 |

|---|---|---|---|

| Figure AI | BMW Spartanburg | 판금 부품 운반 | 파일럿 완료 (30K대 기여) |

| Agility (Digit) | Amazon/GXO | 토트 재활용 | 활성 배치 (100K+ 토트) |

| Boston Dynamics | Hyundai | 공장 운영 | 배치 중 |

| Apptronik | Mercedes Berlin | 공장 내 물류 | 파일럿 진행 중 |

| Sanctuary AI | Magna | 부품 분류 | 파일럿 진행 중 |

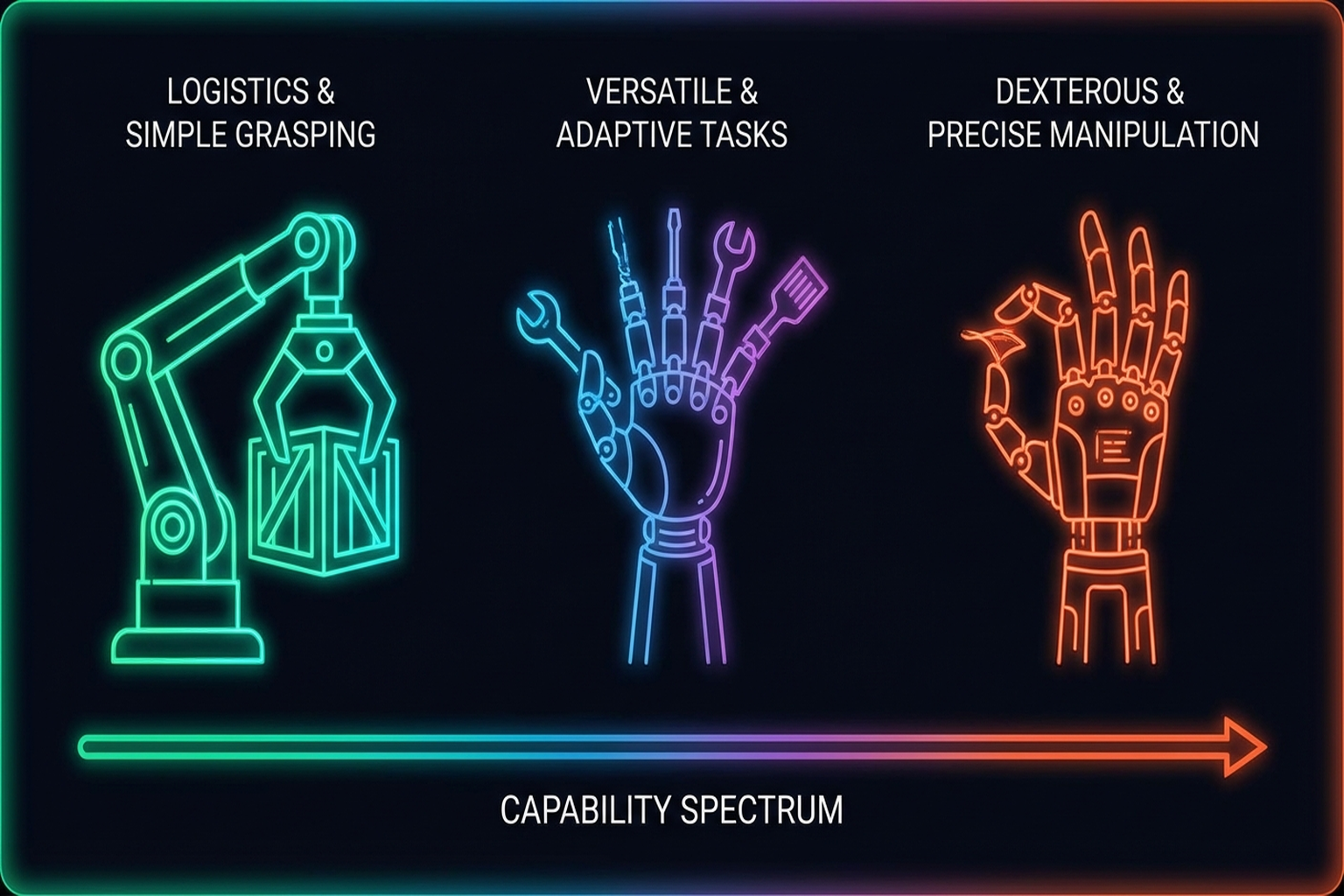

그러나 Billard & Kragic [9]이 지적한 바와 같이, 현재의 공장 배치는 대부분 물류(pick-move-place) 수준에 머물러 있습니다. 촉각 피드백이 필수적인 정밀 조립(dexterous assembly)은 아직 생산 현장에 도달하지 못했습니다. 이 격차를 메우는 것이 향후 5년간 촉각 로봇 공학의 핵심 과제입니다 (→ Chapter 12, 13 참조).

1.5.2 한국 생태계의 위치

한국은 촉각 로봇 분야에서 독특한 생태계를 구축하고 있습니다:

- Hyundai: Boston Dynamics 자회사 보유, KRW 125.2조 투자, Electric Atlas 공장 배치

- Samsung: Rainbow Robotics 35% 지분, CEO 직속 Future Robotics Office (KAIST 오준호 교수)

- Wonik Robotics: Allegro Hand ($16K) — 연구용 사실상 표준. Meta FAIR과 Digit Plexus 통합 추진

- KAIST/ETRI: 차세대 센서 및 소재 연구

이 수직 통합(vertical integration) — 하드웨어(Hyundai-BD) + 하드웨어(Samsung-Rainbow) + 센서(Wonik-Meta) + 기초연구(KAIST/ETRI) — 은 글로벌 관점에서도 드문 구조입니다 (→ Chapter 12.2 참조).

1.5.3 일상 응용

1X Technologies의 NEO ($20K, 소비자용 휴머노이드)는 2026년 미국 가정에 배치를 시작하며, 일상 환경에서의 촉각 기반 조작이 현실이 되고 있습니다. 문손잡이를 돌리고, 서랍을 열고, 접시를 옮기는 등 인간 환경은 손을 위해 설계되어 있으며, 이것이 범용 로봇에게 다지 조작 능력이 필수인 근본적 이유입니다.

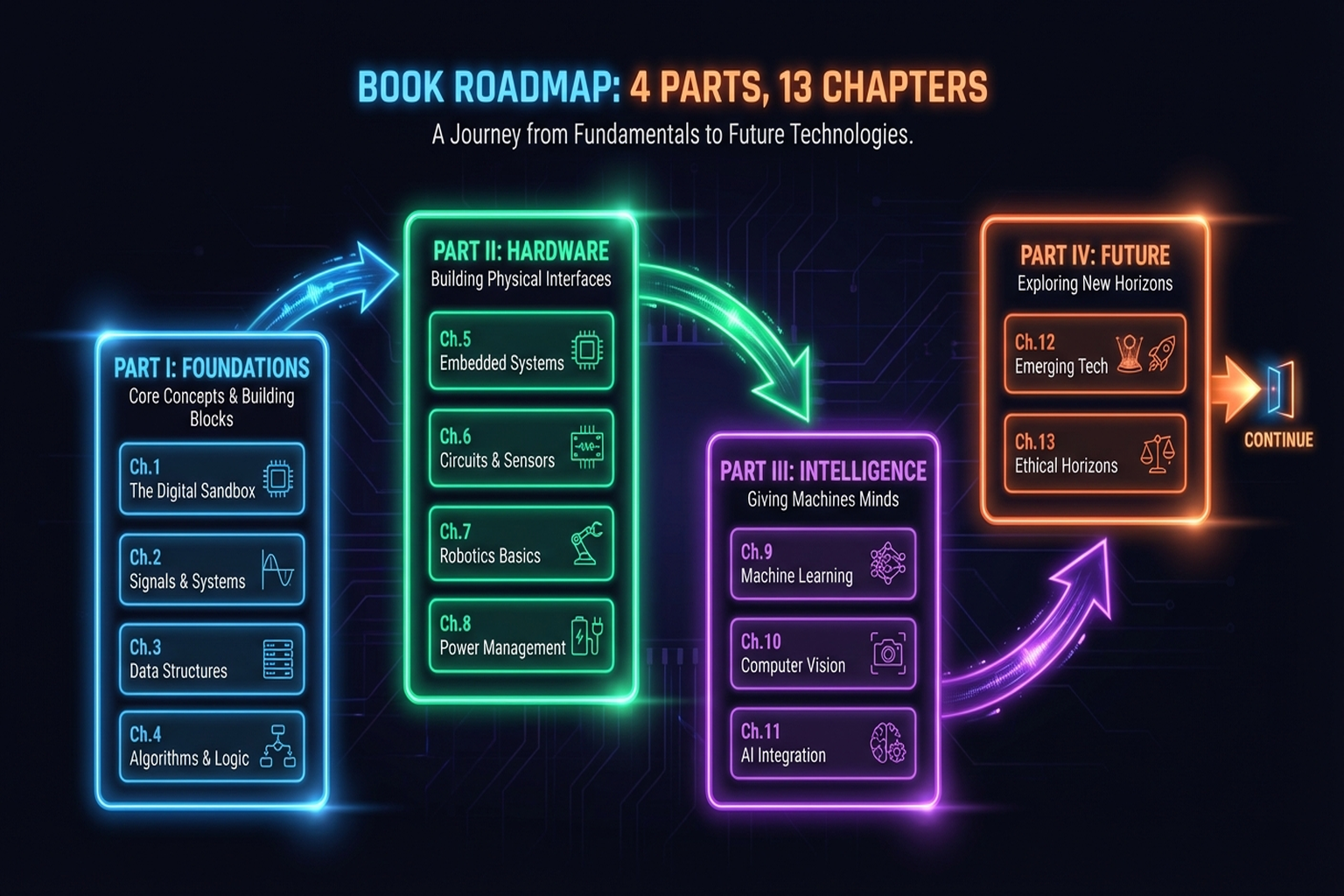

1.6 이 책의 구성과 로드맵

이 책은 4개 파트, 13개 챕터로 구성되며, 기초부터 응용까지 촉각 기반 로봇 조작의 전체 그림을 그립니다.

Part I — 촉각의 기초 (Chapter 1-3): 촉각의 동기와 생물학적 기초(본 챕터)로 시작하여, 센서 기술의 물리적 원리(Chapter 2)와 촉각 데이터의 표현 및 수집 방법(Chapter 3)을 다룹니다. 이 세 챕터는 이후의 모든 논의를 위한 언어와 개념을 제공합니다.

Part II — 로봇 핸드와 인간 손 (Chapter 4-6): 로봇 핸드의 설계 원리(Chapter 4)와 지능형 메커니즘의 물리적 지능(Chapter 5)을 살펴본 후, 인간 손 데이터를 수집하는 다양한 접근법(Chapter 6)을 소개합니다. 여기서 "기계가 어떻게 잡는가"와 "인간은 어떻게 가르치는가"의 두 축이 만납니다.

Part III — 학습과 전이 (Chapter 7-10): 촉각 기반 조작 학습(Chapter 7)에서 시작하여 VLA 모델의 최전선(Chapter 8), 시뮬레이션에서 현실로의 전이(Chapter 9), 인간에서 로봇으로의 기술 전이(Chapter 10)까지 다룹니다. 이 파트는 책에서 가장 많은 최신 연구를 포함하며, 현 연구 커뮤니티의 가장 활발한 영역을 반영합니다.

Part IV — 통합과 전망 (Chapter 11-13): 다중 모달 시스템 통합의 연구적 성과(Chapter 11), Physical AI와 산업 전망(Chapter 12), 그리고 공통 한계점과 미래 연구 방향(Chapter 13)으로 마무리합니다. 특히 Chapter 13에서는 메커니즘 + 촉각 + 학습의 삼각 통합이라는 연구 방향을 제안합니다.

각 챕터는 독립적으로도 읽을 수 있도록 설계되었지만, 순차적으로 읽을 때 가장 자연스러운 흐름을 경험할 수 있습니다. 모든 챕터에는 핵심 논문 박스, Figure 자리 표시, 교차 참조가 포함되어 있으며, 챕터 말미에 해당 챕터의 참고문헌이 APA 형식으로 정리됩니다.

요약 및 전망

촉각은 로봇 조작의 "마지막 퍼즐 조각"입니다. 비전 기반 센서의 저비용화, 저비용 오픈소스 핸드의 민주화, 그리고 대규모 Foundation Model의 등장이라는 세 가지 흐름이 수렴하면서, 촉각 로봇 공학은 역사상 가장 빠른 속도로 발전하고 있습니다. 2026년 현재, Sanctuary AI가 5mN 민감도의 촉각을 상용 휴머노이드에 통합하고, NVIDIA의 합성 데이터 파이프라인이 780K 궤적을 11시간에 생성하며, pi0/RECAP이 배치 후 강화학습으로 지속 개선을 실현하는 등 — 촉각은 더 이상 선택 사항이 아니라 표준이 되고 있습니다.

다음 챕터에서는 이 촉각을 물리적으로 구현하는 센서 기술의 세계로 들어갑니다 (→ Chapter 2: 촉각 센서 기술 참조).

참고문헌

- Johansson, R. S., & Flanagan, J. R. (2009). Coding and use of tactile signals from the fingertips in object manipulation tasks. Nature Reviews Neuroscience, 10, 345-359. https://doi.org/10.1038/nrn2621 scholar

- Kandel, E. R., Schwartz, J. H., & Jessell, T. M. (2000). Principles of Neural Science (4th ed.). McGraw-Hill. scholar

- Dahiya, R. S., Metta, G., Valle, M., & Sandini, G. (2010). Tactile sensing: From humans to humanoids. IEEE Transactions on Robotics, 26(1), 1-20. https://doi.org/10.1109/TRO.2009.2033627 scholar

- Yuan, W., Dong, S., & Adelson, E. H. (2017). GelSight: High-resolution robot tactile sensors for estimating geometry and force. Sensors, 17(12), 2762. https://doi.org/10.3390/s17122762 scholar

- Lambeta, M., Chou, P.-W., Tian, S., Yang, B., Maloon, B., Most, V. R., ... & Calandra, R. (2020). DIGIT: A novel design for a low-cost compact high-resolution tactile sensor with application to in-hand manipulation. IEEE Robotics and Automation Letters, 5(3), 3838-3845. https://arxiv.org/abs/2005.14679 scholar

- Lambeta, M., Wu, T., Sengul, A., & Calandra, R. (2024). Digitizing touch with an artificial multimodal fingertip (Digit 360). arXiv preprint, arXiv:2411.02834. scholar

- Shaw, K., Agarwal, A., & Pathak, D. (2023). LEAP Hand: Low-cost, efficient, and anthropomorphic hand for robot learning. Robotics: Science and Systems (RSS). scholar

- Hogan, N. (1985). Impedance control: An approach to manipulation. Journal of Dynamic Systems, Measurement, and Control, 107(1), 1-24. https://doi.org/10.1115/1.3140702 scholar

- Billard, A., & Kragic, D. (2019). Trends and challenges in robot manipulation. Science, 364(6446), eaat8414. scholar

- Yin, Z.-H., Huang, B., Qin, Y., Chen, Q., & Wang, X. (2023). Rotating without seeing: Towards in-hand dexterity through touch. Robotics: Science and Systems (RSS). scholar

- Pitz, J., Röstel, L., Sievers, L., & Bäuml, B. (2024). Dextrous tactile in-hand manipulation using a modular reinforcement learning architecture. IEEE-RAS International Conference on Humanoid Robots. scholar

- Suresh, S., Si, Z., Anderson, S., Kaess, M., & Mukadam, M. (2024). NeuralFeels: Neural fields for visuotactile perception. Science Robotics, 9(86). scholar

- Yang, F., Feng, C., Chen, Z., Park, H., Wang, D., Dou, Y., ... & Wong, A. (2024). Binding touch to everything: Learning unified multimodal tactile representations. CVPR 2024. scholar

- Lepora, N. F. (2025). Tactile Robotics: Past and Future. arXiv preprint, arXiv:2512.01106. scholar

- Various. (2025). Recent advances in tactile sensing technologies for human-robot interaction: Current trends and future perspectives. Sensors International. https://doi.org/10.1016/j.sintl.2025.100345 scholar

- Zhao, Z., Li, W., Li, Y., Liu, T., Li, B., Wang, M., Du, K., Liu, H., Zhu, Y., Wang, Q., Althoefer, K., & Zhu, S.-C. (2025). Embedding high-resolution touch across robotic hands enables adaptive human-like grasping. Nature Machine Intelligence. https://doi.org/10.1038/s42256-025-01053-3 #39 scholar

- Zhao, C., Yu, Y., Ye, Z., Tian, Z., Zhang, Y., & Zeng, L.-L. (2025). Universal slip detection of robotic hand with tactile sensing. Frontiers in Neurorobotics, 19. https://doi.org/10.3389/fnbot.2025.1478758 scholar

- Lin, P., Huang, Y., Li, W., Ma, J., Xiao, C., & Jiao, Z. (2025). PP-Tac: Paper picking using omnidirectional tactile feedback in dexterous robotic hands. Robotics: Science and Systems (RSS) 2025. #12 scholar

- Cho, W., et al. (2025). Multi-dimensional tactile sensing for force/noise decoupling. ACS Applied Materials & Interfaces. scholar

- Hossain, M., et al. (2025). Multi-axis tactile for object orientation detection. Sensors and Actuators A: Physical. scholar

- Chen, C., Yu, Z., Choi, H., Cutkosky, M., & Bohg, J. (2025). DexForce: Extracting force-informed actions from kinesthetic demonstrations for dexterous manipulation. IEEE Robotics and Automation Letters. arXiv:2501.10356. #3 scholar